במשך שנים ארוכות, כשמישהו דיבר על שבב מחשב, הוא התכוון לדבר אחד בלבד, ה-CPU.

ה-Central Processing Unit הוא המעבד הוותיק שכולנו מכירים, זה שמאז שנות השבעים מהווה את הלב הפועם של כל מחשב, שרת ומכשיר דיגיטלי.

ואז הגיעה הבינה המלאכותית ופירקה את המעבד הזה.

לפתע שמענו על GPU, TPU ו-ASIC, ומניות חברות ה-CPU נתפסו כעסקי העתיד הישן.

אבל 2026 שינתה את הנרטיב הזה בצורה דרמטית, INTEL הפתיעה בדוח Q1 חזק, AMD זינקה בחדות, ו-ARM הפכה לאחת המנצחות הגדולות של השנה. כדי להבין למה זה קורה דווקא עכשיו, צריך לחזור לבסיס.

מה עושה ה-CPU בפועל

ה-CPU הוא המעבד הגנרלי והורסטילי ביותר שקיים.

הוא מסוגל לבצע מגוון עצום של משימות, מניהול מערכת ההפעלה ועד עיבוד לוגי מורכב והוא זה שמאפשר לשאר הרכיבים במחשב לתאם ביניהם.

אפשר לחשוב עליו כמנהל ראשי, יסודי ומדויק, שמחליט מה כל חלק אחר במערכת צריך לעשות בכל רגע נתון. בניגוד לשבבים מתמחים, ה-CPU לא מוגבל לסוג חישוב מסוים, הוא יודע להתמודד עם בעיות מורכבות, לקבל החלטות מסועפות ולנהל זרמי מידע במקביל.

כל מחשב, טלפון, שרת ענן ומערכת דיגיטלית מכילים CPU. בלי המעבד הזה, שום מערכת לא באמת יכולה לפעול.

המגבלה של CPU והכניסה של שבבים אחרים לשוק

ל-CPU יש מגבלה מובנית, הוא עובד בצורה סדרתית יחסית, משימה אחרי משימה, גם אם במהירות גבוהה מאוד.

כדי להבין למה, צריך להכיר מושג אח שנקרא ליבה. בתוך כל CPU יושבות יחידות עיבוד שנקראות ליבות.

כל ליבה היא מעבד עצמאי בפני עצמו, שמסוגל לקבל הוראה, לעבד אותה ולהחזיר תוצאה.

מעבד עם ליבה אחת מסוגל לבצע פעולה אחת בכל רגע נתון. הוא עובר בין משימות במהירות גבוהה, אבל לא מעבד אותן בו-זמנית באמת.

מעבד עם שמונה ליבות מסוגל לבצע שמונה פעולות שונות בו-זמנית באמת, כי כל ליבה עוסקת בחישוב משלה, ולכן ככל שיש יותר ליבות, כך המערכת מסוגלת להתמודד עם יותר עומס בפועל.

ה-CPU בנוי עם מספר קטן יחסית של ליבות, אבל כל אחת מהן חזקה מאוד ומסוגלת להתמודד עם לוגיקה מורכבת, החלטות שמובילות לכמה כיוונים אפשריים ומשימות שדורשות גמישות מחשבתית גבוהה.

הוא המעבד הכי חכם בחדר, אבל בעולם שבו מודלי AI דורשים חישובים מסיביים של מטריצות, חוכמה לבד לא מספיקה, צריך כמות.

כאן נכנסים השחקנים האחרים, וההבדלים ביניהם הם לא עניין של גוון, הם הבדלים מהותיים בפילוסופיית העיצוב עצמה.

ה-GPU נבנה מלכתחילה לעולם הגרפיקה ולעולם הגיימינג, שם היה צורך לעבד מיליוני פיקסלים בו-זמנית. הפתרון היה ארכיטקטורה של אלפי ליבות קטנות ופשוטות שעובדות במקביל, בניגוד גמור לליבות המעטות והחזקות של ה-CPU. כל ליבת GPU עושה פעולה פשוטה, אבל כולן ביחד מייצרות עוצמה עצומה.

כשהתברר שחישובי מטריצות של AI דומים מבנית לחישובי גרפיקה, ה-GPU הפך לסוס העבודה של מהפכת הבינה המלאכותית. NVIDIA הבינה את זה לפני כולם ובנתה סביב ה-GPU שלה אקו-סיסטם שלם כמו מערכת ה-CUDA, פלטפורמת תוכנה שמאפשרת להריץ חישובים על ה-GPU.

בעצם החפיר האמיתי של NVIDIA הוא לא רק השבב, אלא הפלטפורמה עצמה.

ה-TPU של גוגל הוא צעד נוסף בכיוון ההתמחות.

אם ה-GPU הוא כלי גמיש שהסתגל לעולם ה-AI, ה-TPU נולד ישירות לתוכו. גוגל בנתה אותו מאפס עם מטרה אחת, לבצע פעולות מטריצות של AI מהר ויעיל ככל האפשר.

התוצאה היא שבב שמציג יעילות אנרגטית גבוהה משמעותית מ-GPU לפעולות אימון והסקה של מודלים גדולים.

אבל ל-TPU יש גם מחיר, הוא לא גמיש. הוא עובד הכי טוב עם TensorFlow (ספריית תוכנה) ומתאים בעיקר לשיטות עבודה ספציפיות, ונגיש רק דרך Google Cloud. מי שנמצא בתוך האקו-סיסטם של גוגל מרוויח מיתרון ביצועים אמיתי, מי שמחוצה לו כמעט לא יכול לגשת אליו.

ה-ASIC הוא הקצה הקיצוני של הספקטרום. אם ה-CPU הוא מנהל כללי, ה-GPU הוא מנוע מקבילי, וה-TPU הוא מומחה AI, אז ה-ASIC הוא מכונה שנבנתה למשימה אחת בלבד, ולא יודעת לעשות שום דבר אחר, אין גמישות, אין פשרות, רק אופטימיזציה מושלמת לפעולה ספציפית.

זו הסיבה שה-ASIC מציג את יחס הביצועים לאנרגיה הגבוה ביותר שקיים, כשלא צריך לתמוך בשום שימוש נוסף, כל טרנזיסטור בשבב עובד בדיוק במקום שבו הוא נדרש. חברות ענק כמו אמזון עם Trainium ו-Inferentia, מטא עם MTIA וגוגל עם דורות ה-TPU המתקדמים כבר בונות ASIC ייעודיים משלהן, כי בסדרי הגודל שבהם הן פועלות, אפילו שיפור קטן ביעילות מתורגם לחיסכון של מיליארדים בשנה.

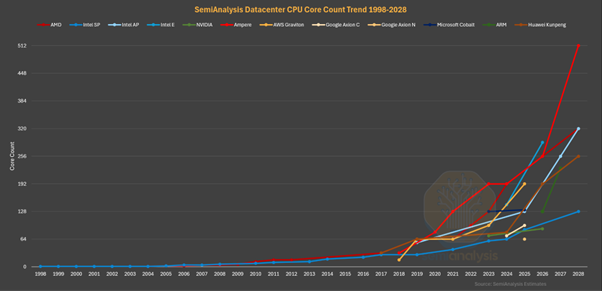

בגרף המצורף ניתן לראות בבירור שה-CPU לא נעלם, הוא עובר שינוי עמוק.

במקום מעט ליבות חזקות, התעשייה עוברת למאות ליבות במקביל כדי להתאים לעולם ה-AI, כשהמובילה מבין החברות (וכרגע לפחות, מובילה בפער גדול) היא AMD.

המעבר מאימון להסקה, נקודת המפנה

אז אם ה-GPU הוביל את מהפכת ה-AI, למה חוזרים לדבר על CPU?

התשובה היא הסקה, Inference.

עולם ה-AI מתחלק לשני שלבים שונים לחלוטין, ואי אפשר להבין את אחד בלי להבין את השני.

השלב הראשון הוא האימון. כאן המודל לומד, הוא מעבד כמויות עצומות של נתונים, מתאים את הפרמטרים שלו שוב ושוב, ובונה את היכולת להבין שפה, תמונות או כל דומיין אחר שמלמדים אותו.

תהליך האימון של מודל כמו GPT-4 נמשך שבועות עד חודשים, רץ על אלפי כרטיסי GPU במקביל, וצורך כמויות חשמל שמתאימות לעיר קטנה. זו פעילות חד פעמית, עושים אותה פעם אחת, ואז המודל מוכן.

השלב השני הוא ההסקה, וזה השלב שמתרחש מיליוני פעמים ביום.

ההסקה היא הרגע שבו המודל המאומן פוגש את העולם האמיתי ומשתמש בידע שרכש כדי לתת תשובה. כשאתה שואל שאלה ב-ChatGPT, זו הסקה. כשמצלמת הסמארטפון שלך מזהה פנים ונועלת את המסך, זו הסקה. כשמערכת ניווט מחשבת מסלול חלופי בגלל פקק שזוהה בזמן אמת, זו הסקה. כשאלגוריתם של אינסטגרם מחליט בשבריר שנייה איזה פוסט להציג לך בפיד, גם זו הסקה.

ההבדל הקריטי הוא שהאימון הוא תהליך כבד שרץ בסביבה מבוקרת, בעוד שההסקה חייבת להיות מהירה, זולה ויעילה, לרוב על שרתים רגילים או על מכשירי קצה, לא על חוות GPU יקרות.

וכאן בדיוק ה-CPU חוזר למרכז. הוא לא מחליף את ה-GPU, אלא משלים אותו. בעולם של AI אג'נטי ועיבוד מידע, יש צורך במעבד כללי שינהל תהליכים בזמן אמת, יתאם בין רכיבים ויפעיל פקודות וזה תפקידו של ה-CPU.

כל מערכת AI שרצה מחוץ לחדר שרתים ייעודי, בין אם זה בטלפון, במכונית, בשעון חכם, בנתב ביתי, נשענת על CPU שינהל את תהליך ההסקה המקומי.

ככל שה-AI ימשיך לחדור לכל מכשיר ושירות, כך תתרחב הדרישה לכוח עיבוד מסוג CPU ברחבי שרשרת הערך כולה.

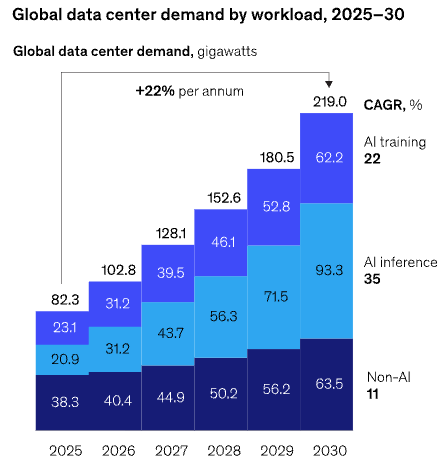

בגרף המצורף אפשר לראות את הביקוש הגלובלי לדאטה סנטרים, שצפוי לגדול מ-82 גיגה-וואט שהיה ב-2025 ל-219 גיגה-וואט ב-2030, צמיחה שנתית ממוצעת (CAGR) של 22%.

המספר שבולט מעל כולם וצריך לשים לב אליו הוא דווקא ה-Inference, ההסקה.

מדובר בסגמנט שצומח הכי מהר עם CAGR של 35% לשנה, מהר יותר אפילו מהאימון עצמו.

האם המרוויחות ימשיכו להרוויח?

הנרטיב הזה כבר מתבטא בצורה ברורה בשוק.

אינטל (INTC) זינקה כמעט 25% ביום אחד בעקבות דוח Q1 2026, העלייה הגדולה ביותר שלה מאז 1987 והשלימה תשואה חודשית של למעלה מ-100% !

מה שהפתיע את השוק לא הייתה רק שורת ההכנסות, אלא דווקא המקום שממנו הגיעה הצמיחה.

מגזר הדאטה סנטר וה-AI של אינטל צמח 22% שנה-על-שנה, כשמנכ"ל החברה, ליפ בו-טאן הסביר שהגל הבא של ה-AI ידרוש הסקה שרצה קרוב למשתמש, על שרתים ועל מכשירי קצה וה-CPU של אינטל הוא בדיוק מה שמאפשר זאת.

בנוסף, אינטל חתמה על עסקה רב-שנתית עם גוגל לפריסת מעבדי Xeon לצד יחידות IPU ייעודיות בתשתיות הענן של גוגל, מה שהפך את הסיפור מספקולטיבי לאנקור עסקי אמיתי.

AMD עלתה בשיאה כ-80% במהלך חודש אפריל לבדו.

מגזר הדאטה סנטר של AMD הגיע לשיא של 5.38 מיליארד דולר ב-Q4 2025, עלייה של 34% משנה לשנה.

AMD לא מסתמכת רק על ה-CPU, היא משלבת אותו עם מאיצי AI מסדרת MI300, כך שהיא מציעה ללקוחות כמו OpenAI, Oracle ו-HPE פתרון משולב של הסקה ואימון תחת קורת גג אחת.

(Arm Holdings (ARM עלתה כ-14% ביום שאחרי דוח אינטל, והציגה תשואה של כ-70% בחודש החולף. המודל של Arm שונה מהשאר כי היא לא מייצרת שבבים בעצמה, היא מרשה לחברות אחרות להשתמש בארכיטקטורה שלה ומקבלת תמלוגים על כל שבב שמיוצר.

כמעט כל סמארטפון, טאבלט ושבב Edge AI (בינה מלאכותית שרצה ישירות על המכשיר, ללא צורך בענן) בעולם מבוסס על עיצוב של Arm, מה שהופך אותה למנצחת של מגמת ה-Edge AI ללא קשר לשאלה מי ינצח בתחרות הייצור.

השאלה לגבי המשך היא לא האם הביקוש קיים, כי הוא קיים וגדל כל הזמן.

השאלה היא האם המחירים הנוכחיים כבר מתמחרים את כל הצמיחה הצפויה. AMD נסחרת ב-P/E של מעל 130, Arm נסחרת במכפילים שמניחים צמיחה של שנים קדימה, ואינטל, למרות הקפיצה, עדיין נמצאת בתהליך תיקון ארוך ולא הוכיחה שהיא חזרה לצמיחה יציבה.

אבל הכיוון הוא ברור וחד משמעי, ה-CPU חוזר וחוזר בגדול.

המבט קדימה, מי ינצח?

הסיפור האמיתי הוא לא GPU מול CPU ואין באמת מנצחות בכל הסיפור הזה כי המציאות מורכבת יותר. ה-GPU ימשיך להוביל את תחום האימון. ה-TPU יישאר יתרון תחרותי לגוגל בתוך הענן שלה. ה-ASIC יהפוך לכלי אסטרטגי של חברות ענן גדולות. וה-CPU יהיה עמוד השדרה של שכבת ההסקה ושל מערכות שפועלות מחוץ לחוות שרתים.

העולם הזה לא בנוי על מנצח אחד, אלא על שילוב בין רכיבים שונים, שכל אחד מהם ממלא תפקיד אחר.

השאלה הגדולה קדימה היא איך ייראה האיזון ביניהם בעוד כמה שנים, כי הארכיטקטורה של עולם ה-AI ב-2030 עשויה להיות שונה לגמרי ממה שאנחנו מכירים היום.

גיא נתן, מנכ"ל ומייסד של גיא נתן בע"מ, מנהל קרן הגידור Valley, כותב פיננסי ב־Ynet Capital, עיתון "בשבע" ואתר ספונסר, מרצה ומנחה פודקאסט "מפת החום", פאנליסט כלכלה שבועי בערוץ הכלכלה (10) תוכנית "תל אביב – ניו יורק" ואורח קבוע בתוכנית "היום שהיה" בערוץ 13

אין לחברת ידיעות תקשורת בע״מ, לאתר ynet או לחברת המברקה פתרונות תקשורת בע״מ זיקה כלשהי לתוכן במובן של ניגוד עניינים או של עניין מיוחד. הכתוב אינו מהווה ייעוץ השקעות ו/או תחליף לייעוץ המתחשב בנתונים ובצרכים המיוחדים של כל אדם. אין לראות במידע בסקירה זו כעובדתי או כמכלול כל המידע הידוע, ולכן אין להסתמך על הכתוב בה ככזה.