האם גם אתם מתייעצים עם הצ'אט בענייני לב שבור או משבר במקום העבודה? בעיית ההתמכרות לייעוץ אישי ופסיכולוגי באמצעות צ'אט GPT הולכת ומחמירה. אנשים, בעיקר צעירים מתחת לגיל 30, נוטים לסמוך על הצ'אט שיפתור להם את מצוקות החיים. זה מסתיים לעיתים בעצות לא מקצועיות, מסוכנות ואפילו לתמיכה במחשבות אובדניות.

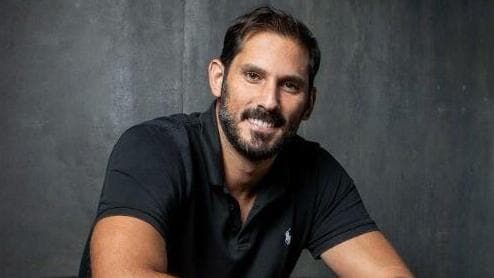

התופעה הזו מדאיגה בהחלט את חברת OpenAI שמפתחת ומפעילה את צ'אט GPT. לפני כמה שבועות קיים סם אלטמן, מנכ"ל החברה, ישיבה בעניין הזה עם מספר מצומצם של מנכ"לי חברות סטארט-אפ שנמצאים עימו בשיתוף פעולה. אחד מהם היה דן להב, מנכ"ל חברת אירגולר (Irregular) הישראלית. "מה שעלה שם, זה שאנשים מעל גיל 30 מתייחסים לצ'אט כתחליף לגוגל, אבל טינאייג'רים מסתכלים עליה בגדול כמערכת הפעלה לחיים".

זו הנקודה שבה הטכנולוגיה שמפתחים באירגולר הקטנה מתל אביב יכולה לסייע לענקית הבינה המלאכותית מסן פרנסיסקו: זיהוי דפוסי השאלות של המשתמשים וניסיון להבין למה ה-AI עונה תשובות לא אחראיות שגורמות לצעירים למצוקה, אפילו להתנהגות מסוכנת. יש שיגידו שה-AI עושה הנדסה חברתית למשתמשים, לא פחות מהאקרים רוסיים. ואולי בכלל אלה באמת האקרים רוסיים, שהצליחו לחדור את ההגנות של צ'אט GPT ולגרום לו להשפיע בצורה מרחיקת לכת על דור שלם של אמריקאים צעירים?.

המומחיות של אירגולר היא בחקר התפקוד של מנועי AI השונים בניסיון לזהות בהם חולשות ופרצות שעלולות לאפשר להאקרים להשפיע על התנהגותם. "קורה כאן משהו, שברור שהדור הבא של המשתמשים הולכים לחוות התקפות מסוגים חדשים מהסיבה הנורא בסיסית שהשימוש השתנה. וברגע שהשימוש משתנה, כל ההנדסה שמאחור הולכת להשתנות, וכתוצאה מזה אנחנו הולכים לראות המון המון התקפות חדשות וצריך לייצר הגנות חדשות", אומר להב.

להב, ביחד עם השותף להקמת החברה עומר נבו, עושים את הדבר שחברות ישראליות אחרות היו אולי רק חולמות עליו: עבודה מקרוב, כתף לצד כתף, עם חברות הבינה המלאכותית הגדולות בעולם, היכרות אינטימית עם קוד ה-AI שלהן, ובחינה על שולחן הניתוחים של גרסאות AI שטרם יצאו לשוק.

המטרה היא לאתר מבעוד מועד סכנות שיאפשרו להאקרים ולפושעי סייבר להשתמש ב-GPT, או ג'מיני, או קלוד, כדרך לפרוץ לקורבנות, אבל על הדרך השניים האלה נחשפים לשלל ההתנהגויות – לפעמים הביזאריות – של הצ'אטים, ולהתריע על סכנות אחרות שהם מגלים. אם וכאשר תגיע הבינה המלאכותית הכוללת (AGI), השניים משוכנעים שהם יתריעו על סכנות מבעוד מועד, עוד לפני שהיא תשתלט על העולם. "אנחנו ציפור הקנרית במכרה הפחם, שתתריע אם האוויר יתמלא בגזים רעילים", הם אומרים.

זו לא קצת חוצפה לדפוק על הדלת של סם אלטמן, דריו אמודאי (מאנתרופיק), דמיס הסביס (מגוגל דיפ-מיינד), אולי גם אילון מאסק או מארק צוקרברג?

להב: "קודם כל, אנחנו חוצפנים. צריך להגיד שיש יתרון בחינוך הישראלי... יש לנו את התעוזה לבוא ולהגיד שיש דברים שאנחנו יודעים לעשות, שלדעתנו יעזרו".

נבו: "ברור שהבעיות היום מעניינות פחות מ־20 ארגונים ברחבי העולם. אבל ה־20 האלה יהפכו להיות 200 ואחר כך 20,000. ובמקביל מתוך 20 בעיות יצמחו דברים שיעניינו 20,000 בעוד שנה או שנתיים קדימה"

שיחות עם סם אלטמן

החוצפה הזו באה עם רקע תומך. להב ונבו מצויים בתחומי פיתוח ה-AI כבר שנים ארוכות, הרבה לפני שצ'אט GPT פרץ לחיינו. הם הכירו את צוותי הפיתוח של החברות הגדולות בארה"ב ושיתפו איתם פעולה עשר שנים לפני כן. וההיכרות הזו גם הביאה לכך שהם יכלו לזהות את הדבר הענק שהולך ומתעורר זמן רב מראש. "אותנו צ'אט GPT לא הפתיע כשהוא יצא", אומר להב, "וזה מתוך שאם היית בפנים, בתוך התעשייה והיית בקשר עם האנשים הנכונים, הייתה לך הבנה של מה מנסים לעשות. צריך לשמור פה על צניעות מסוימת, כן? זה לא שידענו להגיד כל פרט ממה שהולך לקרות, אבל זה לא שלא היינו ערוכים לדבר הזה. בסוף היינו באמת 'אינסיידרים' של התעשייה, במובן העמוק והאמיתי".

נבו, בעבר איש מחקר ופיתוח בגוגל, ולהב, בעבר איש מחקר ופיתוח ב-IBM, הכירו את הצוותים האמריקאיים דרך שורה של מחקרים משותפים ושיתופי פעולה בסוגיות שונות של עולמות ה-AI. עם הקמת אירגולר המחקרים האלה התמקדו בתפקוד של ה-AI ובגורמים שמסכנים אותו. העבודה בחברה היא ברובה מחקר, והוא גם מקור ההכנסות של החברה. אבל המטרות מאחורי המחקר הלכו וצברו תאוצה: שיתוף הפעולה עם אנשי הפיתוח של החברות הגדולות הגיע לידיעתם של מנהלי האבטחה של החברות שהביעו בו עניין רב מאוד. ואז הוא הגיע לדרג המנהלים של החברות ולגורמים בממשלות — ארה"ב, בריטניה, האיחוד האירופי.

"זה קרה בלוח זמנים של שבועות, מלהתחיל לעבוד עם האנשים האלה בכתיבת מזכרים ואז שהתחלנו להיכלל בתוכניות העבודה של החברות ושל ממשלות בעולם ועם שיחות והעלאת רעיונות עם אנשים כמו סם (אלטמן) שהקדיש לזה זמן לא מבוטל", אומר להב. "מנהלי האבטחה באמת מוטרדים. הם אומרים – אנחנו עושים עבודה שצריך לעשות פעם ראשונה בהיסטוריה: לאבטח מטרה נעה, שמתפתחת בקצבים היסטריים, ואנחנו צריכים להבין איך אנחנו עושים את הדבר הזה".

ואיך קורה שדווקא אתם, חברה קטנה מתל אביב, היא זו שמושיעה את חברות הענק האמריקאיות?

נבו: "כשאתה מדבר עם מנהלי אבטחה, לכל בעיה יש להם 20 חברות שטוענות שהן פותרות אותה. אנחנו מעולם לא שיחקנו את המשחק הזה. לא נגענו בשום מקום שבו היה מישהו שטען שהוא יודע לפתור את הבעיה. הלכנו מראש על בעיות שבהן אמרו לנו — יש פה בעיה שאנחנו לא מבינים איך לגעת בה בכלל. איך להגדיר את השאלה, מאיפה אמור לבוא פתרון".

להב: "חלק מהבעיות, ברור שחייבות להיפתר בתוך החברות, אבל חלק מהדברים הם מומחיות שלא נמצאת בפנים. ואז אנחנו יושבים איתם ושוברים את הראש ביחד — איך עושים את הדברים, מה דוקטרינת ההגנה, איך אנחנו מפתחים יכולת להתבונן לתוך ה-AI, איך מזהים נתיבי חדירה חדשים".

אחת התרומות המשמעותיות של אירגולר הייתה בתופעה שהתבררה ככואבת ביותר: בחודש ינואר השנה חברת דיפסיק הסינית חשפה את מודל ה-AI שלה V1: הוא התמודד ראש בראש ב-GPT, חזק ומדויק, ועם עלויות פיתוח של מיליוני דולרים בודדים – שבריר ממה שעלה ל-OpenAI לפתח את זה. הסינים הצליחו לעשות את זה באמצעות פעולת זיקוק (דיסטילציה) שבה מאמנים AI חדש על תוצאות האימון של AI קודם, במקרה הזה של OpenAI עצמה. אם תרצו – הסינים גנבו את הדאטה מהאמריקאים.

הראשונים לזהות את הבעיה הצפויה היו האנשים של אירגולר. "דיברנו על חשש לתקיפת דיסטילציה מיום הקמת החברה", אומר נבו, "התוקפים שואלים את המודל מלא שאלות לגיטימיות, מפעילים אלפי יוזרים ששואלים שאלות, ובפועל מעתיקים את מודל ה-AI. לפני האירוע של דיפסיק צחקו עלינו, טענו מולנו שלא ניתן יהיה לעשות את זה בפועל. אבל אחרי שאתה מוכיח את זה במציאות, אנשים מבינים שזה מפחיד ולכן היום מתעסקים בזה. ושואלים איך ניתן לחסום כזה דבר? להגיד דברים, שחוקרים שעסקו בתחום במעבדות ה-AI אמרו 'לא ידעתי את זה', והם מעלים את הדיון כלפי מעלה, זה מקפיץ אותנו קדימה".

להב: "התפיסה שלנו אומרת שאנחנו נגייס אם נראה שהדבר הזה יקנה לנו יתרון מאוד משמעותי. משקיעים רודפים אחרי החברה אבל כרגע לא ברור לנו שיש בזה ערך אסטרטגי מיידי"

"השכנים מזהים אותי במעלית"

אירגולר הוקמה בנובמבר 2023 על ידי דן להב (מנכ"ל) ועומר נבו (סמנכ"ל טכנולוגיות). לא מזמן נכנסו למשרדים החדשים בבניין עזריאלי טאון בתל אביב. המשרדים רחבי ידיים אבל מתמלאים במהירות. החשיפה שלהם בספטמבר האחרון הביאה לגל של פונים, גם עובדים וגם חברות בתחום. "היה זרם פניות די משתולל בחודשיים האחרונים", אומר להב, "חברות שרוצות לדבר, מאות אם לא אלפי מועמדים שהגישו בקשות, היינו צריכים לבנות את תהליך הגיוס מחדש שידע להתמודד עם קיבולת של פי 50 מהנורמות שלנו. אמנם תיכננו לגייס עובדים אבל הופתענו מהגידול בכמויות שהיו פה". ונבו מוסיף: "ההשפעה של החשיפה מדהימה. השכנים מזהים אותי במעלית, כל קרובי המשפחה פתאום מתקשרים להורים שלי, ynet עשה אותנו סלבים מקומיים".

ההתלהבות הזו מאפיינת גם את הלקוחות. שנתיים אחרי הקמתה אירגולר היא חברה רווחית, שזה דבר יוצא דופן בקרב חברות סטארטאפ. הכנסותיה מגיעות למיליוני דולרים בשנה, מרביתם מענקיות ה-AI גוגל, אנתרופיק ו-OpenAI שמממנות את המחקרים בסכומים גבוהים, והכנסות נוספות מגיעות מממשלות כמו בריטניה והאיחוד האירופי. משקיעים נאבקים על הזכות להשקיע בה. בספטמבר האחרון היא הודיעה על שני גיוסים שנעשו בזה אחר זה, כמעט בצמידות: סבב סיד וסבב A בהיקף של 80 מיליון דולר, מהגדולים שהיו בישראל בסבבים האלה.

למה לא הלכתם בדרך הרגילה ודיווחתם על גיוס סיד ואז גיוס A?

להב: "זה קרה בקצב כל כך מהיר שבכלל אי-אפשר היה להספיק אחרת. היו כמה שבועות בין לבין".

את גיוס ההון באירגולר הובילו קרנות הענק האמריקאיות Sequoia Capital ו-Redpoint Ventures והשתתפה בו קרן Swish Ventures של עמרי כספי. עוד שמות בולטים בין משקיעי החברה הם אסף רפפורט, מנכ"ל וויז שנמכרה לגוגל, ואופיר ארליך, מנכ"ל היוניקורן Eon. השיטה של סיקויה מוכרת מהשקעות קודמות: מגייסים קבוצת קרנות מרשימה, משקיעים הרבה כסף בחברה שיכולה לייצר הרבה הייפ, מה שמנוצל היטב להגעה ללקוחות חדשים וגם לגיוס משקיעים נוספים לחברה. בינתיים שווי החברה עולה עד לשלב המכירה במיליארדי דולר. ראינו את זה קורה בוויז. אין סיבה שזה לא יקרה עם אירגולר.

הייתם צריכים הסברים ארוכים כדי לשכנע את המשקיעים? או שזה היה פיץ' מעלית?

להב: "הפיץ' היה מאוד פשוט, 'אנחנו צריכים עוצמה מחקרית מאוד גדולה כדי לזהות את ההתקפות החדשות כי מתוך הדבר הזה אנחנו נבנה את ההגנות החדשות'. וכמה דוגמאות לאיך הדבר הזה קורה. בסוף היה מאוד קל להסביר תוך פחות מדקה. אבל אני אגיד שאנחנו לא היינו אף פעם בסיטואציית המעלית הזאת. אנחנו עדיין לא בטוחים איך הרבה מהמשקיעים הגיעו אלינו".

אתם די מפונקים. יזמים אחרים לא ישנים בלילה מחשש שלא ימצאו משקיעים

נבו: "יש פה הרבה מזל. אנחנו יכולים להיות מפונקים ולהגיד שיבואו אלינו - זה נכון למשקיעים, זה נכון לעובדים. אבל אנחנו באמת שמחים נורא על זה שיצאה לנו ההזדמנות להיות במצב הזה ושהפיץ' שלנו אומר 'יש פה בעיה ענקית, יש פה מחקר גדול שעם מידה מסוימת של סבלנות הולך לשנות את העולם'. זה מתאים לסוג מסוים של משקיעים, שלמזלנו נוטים להיות המשקיעים הכי טובים בעולם".

להב: "ה-AI הוא קצת כמו בני אדם, אתה אומר לו מה לעשות ונורא חשוב לו להצליח. וכמו שיש עובדים שמחבלים לעובדים אחרים כדי להתקדם קדימה, אז גם סוכן ה־AI הזה החליט לחבל לאחרים"

"הפאלו אלטו הבאה"

המודל העסקי של אירגולר אכן נוטה להיות לא זה הרגיל. חברות, בעיקר בעולמות הסייבר, מתחילות במספר לקוחות טיפוסיים ומשם מתרחבות למאות ואלפי לקוחות בעלי צרכים דומים. השוק הפוטנציאלי של אירגולר נראה מוגבל בהיקפו – כעשר חברות שמפתחות AI, אולי פחות. גם אם היקף הפעילות איתן יגדל משמעותית, זו עדיין לא תהיה צמיחה מטאורית.

מייסדי אירגולר מסתכלים על זה קצת אחרת. להב: "השם אירגולר נבחר כי אנחנו חיים בזמנים לא רגילים שמחייבים חברות לא רגילות. יש חברות צומחות על בסיס המוצר שלהן, יש חברות שצומחות על בסיס המכירות שלהן, אנחנו תופסים את עצמנו כמי שיצמחו על בסיס המחקר שלנו, קצת כמו חברות ה-AI עצמן בימים הראשונים שלהן. נוצר כאן ערך ענק, בין השאר בגלל הסיכון הגבוה, ואנחנו מאוד גלויים עם המשקיעים שלנו בעניין. אנחנו מפתחים גוף מחקרי שהוא תחרותי ונותן ערך לגופים הכי חזקים בעולם, כולל מכירות ומוצרים".

נבו: "היופי הוא שהתהליך מתקדם בכיוון ברור. מתוך הבעיות שרואים במעבדות היום, ברור שהיום הן מעניינות פחות מ-20 ארגונים ברחבי העולם. אבל ה-20 האלה יהפכו להיות 200 ואחר כך 20,000. ובמקביל אנחנו יכולים לראות את הבעיות שהיום מעניינות רק 20 חברות בעולם אבל מתוכם יצמחו דברים שיעניינו 20,000 בעוד שנה או שנתיים קדימה".

להב: "המודלים מכניסים פנימה את כל היתרונות הענקיים שבינה מלאכותית יכולה להציע אבל גם את כל הסכנות שהיא עלולה לגרום. אנחנו מבחינתנו שחקן של יותר מהגנת סייבר, אנחנו שחקן מאפשר. המטרה שלנו לעבוד עם תחזית של לפעמים שנתיים-שלוש קדימה, לפתח את התשתיות שנדרשות כך שכל חברה תוכל להפעיל את הכלים האלה תחת הגנה על מה שהיא עושה".

אנחנו צפויים לראות סבב גיוס נוסף בקרוב? קרנות כמו סיקויה לא אוהבות לחכות הרבה לפני הסיבוב הבא.

להב: "בוא נגיד ככה - הגיוס שעשינו עכשיו מכסה אותנו תקופה ארוכה קדימה. אבל התקופה הזאת היא תקופה מוזרה, קורים בה דברים לא שגרתיים. אנחנו רוצים לדבר עם החברות כדי להבין איך אנחנו מייצרים משהו בריא. אם נשחק נכון, יש פה הזדמנות ליצור חברה דורית יוצאת דופן. התפיסה שלנו אומרת שאנחנו נגייס אם נראה שהדבר הזה יקנה לנו יתרון מאוד משמעותי. משקיעים רודפים אחרי החברה אבל כרגע לא ברור לנו שיש בזה ערך אסטרטגי מיידי".

שון מגווייר מסיקויה אמר בראיון ב-ynet שהמטרה שלו להשקיע בחברות ישראליות שיגיעו לשוויים של עשרות מיליארדי דולר. אתם בדרך לשם?

"זה הרצון שלנו. אנחנו חושבים שהבסיס של מה זה בכלל אבטחת סייבר הולך להשתנות. אנחנו מכניסים בעצם יצורים אוטונומיים, סטוכסטיים (אקראיים) ללב של איך מייצרים ערך. אנחנו רוצים להיות ה'פאוורהאוס', הגורם המניע של אבטחת העידן הזה, שהולך להתנהל בצורה מאוד שונה. מהפכת ה-AI משמעותה החלפת תשתית ענקית והאספירציות שלנו הן גדולות וחזקות, עם המון הערכה לכל מי שבא לפנינו".

נבו: "יש פה הזדמנות אחת לדור לבנות משהו שהוא חדש באמת, וזה מה שאנחנו רוצים לעשות. בנקודה שבה משתנה הדרך של איך בונים עסקים, איך בונים מערכות, איך בונים טק, יש אפשרות לבנות את הפאלו-אלטו הבאה".

איזה סוג של עובדים אתם צריכים? אנשי AI או אנשי סייבר?

להב: "אנחנו צריכים אנשים שיהיו מסוגלים להראות שיש להם ערך מוסף שהחברות לא מסוגלות להשיג פנימית. אנחנו בוחרים בפינצטה את האנשים הכי חזקים בעולם. זה נשמע כמו קלישאה, אני לא חושב שתפגוש אי פעם חברה שלא תגיד לך שיש לה את הצוות הכי חזק בעולם. אבל לנו יש קבלות. בסוף האנשים מהצד השני הם האנשים שהחברות ממיינות בארה"ב, בליבה של מהפכת ה-AI, עם משכורות אסטרונומיות. ועדיין אנחנו מישראל הקטנה יודעים להרים צוות שנותן להם ערך מוסף עמוק".

שותפות שנולדה בדיבייט

יש הרבה קווים מקבילים בחיים של להב ונבו. שניהם למדו בעירוני ד' בתל אביב, שניהם חובבי מדע בדיוני מגיל צעיר. נבו (40), נשוי לשיר (מנהלת מעבדה בבי"ח שיבא) ואב לשני ילדים (בני 6 ושנתיים וחצי). נולד בארץ לאב נוירולוג ואם פסיכולוגית קלינית. להב (35) חי בזוגיות עם אנני, עורכת דין ("הרבה יותר מוכשרת ממני") וגם סגנית אלופת אירופה בדיבייט, שם הם הכירו. נולד בארץ לאם עורכת דין ואבא אקזקיוטיב בכיר בחברות תעשייה בינלאומיות. "בגיל שש או שבע אבא שלי נתן לי את ספר הסיפורים הקצרים של אסימוב כמתנת יום הולדת", אומר להב, "למעשה, ההחלטה שלי ללמוד אנגלית נבעה מכך שרציתי לקרוא את אסימוב בשפת המקור".

אחר כך שניהם התגייסו ליחידות המודיעין של צה"ל, להב ליחידה 81 באמ"ן, נבו ליחידה 8200. למרות היריבות המוכרת בין שתי היחידות, נראה שהשניים חיים בהרמוניה מופלאה. סגנון הניהול שלהם מעניין: למרות שיש חלוקת תפקידים ברורה, שניהם מעורבים בכל התחומים, מקבלים החלטות ביחד.

הם הכירו במפגשי דיבייטינג באוניברסיטת תל אביב, מה שהוביל לדיונים מרתקים, לפעמים חופרים, אגב נסיעות למקומות אקזוטיים ופחות אקזוטיים מסביב לעולם. נבו זכה בתואר אלוף העולם בדיבייטינג ולהב מחזיק בדירוג האישי הגבוה בהיסטוריה באליפות העולם בדיבייטינג.

נבו: "אנחנו המקום המתקדם ביותר בעולם, שמסוגל להסתכל על העוצמה של המודלים, היכולת שלהם לפרוץ הגנות, לבדוק שדברים לא מסתדרים ולתת התראה מוקדמת על בעיה. זו תכלית ענקית שלשמה החברה עובדת"

"כשדיבייט נעשה במיטבו הוא מאפשר לך את היכולת לראות מה עמדת הנגד כדי שתוכל לבנות את העמדה שלך בצורה הרבה יותר חזקה", אומר להב. "התחרות מכילה אלמנטים שיש בעולם הסטארטאפ, שאנחנו רוצים להיות הכי טובים בעולם במשהו ספציפי וללכת לדבר הזה עד הקצה", מוסיף נבו.

אחרי הלימודים להב שימש כחוקר בינה מלאכותית ב-IBM, פרסם מאמרים אקדמיים כולל מאמר שהופיע על שער מגזין Nature. הוא מספר שבשלב הזה, לפני כעשור שנים, התחיל להבין שמשהו מאוד משמעותי הולך לקרות בתחום ה-AI. התחיל שימוש במעבדים של חברת אנבידיה למשימות AI ובמקביל הופיעו מאמרים ראשונים עם הגישות החדשות שהובילו ל-AI של היום: רשתות נוירונים, מודלים של AI, חשיבה היסקית אם להזכיר כמה מהביטויים.

"מבחינתי האובססיה התחילה מהדיבייט", אומר להב, "להעלות טיעונים לוגיים זו אחת הפעולות האנושיות החשובות. רציתי לראות האם מודלי AI יודעים להשתלב בזה, והיו הרבה שנים של מחקר על כל הספקטרום, כתיבת מאמרים שתיארו הכנסה של AI לתוך מוצרים". הוא השתלב במעבדת המחקר של IBM, ובין השאר היה מעורב בפיתוח ה-Debater – סוג קדום של בינה מלאכותית שידעה לנהל ויכוחים עם בני אדם.

נבו השתחרר מ-8200 אחרי 12 שנות שירות, בהם ניהל מדורים בתחום הסייבר: "אמרתי שאני מתרחק קצת מסייבר, הלכתי לאזורים של AI והקמתי סטארטאפ שנקרא Neowize. הטכנולוגיה שבנינו הייתה מאוד ייחודית ובסוף מכרנו את החברה ל-Oddity. אז חיפשתי משהו שבו אני יכול לעשות משהו עם אימפקט חיובי על העולם ועברתי להקים צוות מחקר בתוך גוגל שעוסק בשריפות יער. זה שוב AI, אבל מסוג שונה, שמעבד מידע מלוויינים, מזהה שריפות במקומות שבהם אין בני אדם ומקטין את הסכנה שזה יהפוך לשריפת ענק".

פוטנציאל מסחרי ענק

נבו אהב מאוד את העיסוק שלו בגוגל, אבל אז הגיע אליו להב עם רעיונות שבוערים במוחו: הבינה המלאכותית בפריצה, אבל יש מעט מומחים שמבינים גם ב-AI וגם בהגנת סייבר. "הגענו למסקנה שכמו שהמעבדות הגדולות בעולם - OpenAI ואנתרופיק ו-DeepMind מתמקדות בפיתוח בינה מלאכותית כללית (AGI) או 'סופר אינטליגנציה', צריך שיהיה להם שותף חזק שיעבוד כמו מעבדה באזורים של האבטחה", אומר להב, "אם המטרה שלהם היא לפתח מודלים יותר ויותר מתוחכמים וחזקים, צריך מישהו מאוד משמעותי שיהיה מסוגל להבין לפני שמוציאים את המודלים החוצה, אם הם בטוחים".

אירגולר מגדירה את עצמה כמעבדת האבטחה היחידה בעולם לבינה מלאכותית, שזה אומר להבטיח את עמידותה של הבינה המלאכותית מול מתקפות סייבר מסוכנות ביותר, שנעשות אף הן באמצעות AI ויש להן יכולות שטרם ראינו - יכולת להוליך שולל את ה-AI של הגנת הסייבר ולבצע מתקפות מתוחכמות מעבר ליכולת ההגנה של בני אנוש.

היה ברור לכם שיש פוטנציאל כספי לדבר הזה?

להב: "זה מצחיק, יש כאן שלושה דברים ענקיים שהתלכדו, שהופכים אותנו לדעתי לאנשים הכי בני מזל בעולם. אחד - יש כאן בעיה אינטלקטואלית מעניינת בצורה יוצאת דופן, ואנחנו נמצאים בחזית עם הטכנולוגים הכי טובים בעולם שהחברות משלמות להם מאות מיליוני דולר, משכורות יותר גבוהות משחקני כדורגל.

"שתיים - האימפקט באמת חשוב לנו ואנחנו רואים את היכולת לוודא שבינה מלאכותית תהיה לטובת האנושות כמשימת חיים גדולה ומשמעותית, ועד עכשיו ראינו שיש לנו יכולת להשפיע על לא מעט תהליכים פנימיים שקורים.

"ושלוש - באמת יש פה פוטנציאל מסחרי ענק. בשנייה שנוצרים תחומים חדשים, אז מגיע פוטנציאל ענק בצד המסחרי. יש פה מהפכת תשתיות - אנחנו משנים את היסודות של איך עובדים, וחברות ענק נוצרות בתקופות שסמוכות להחלפה של תשתיות, כמו בזמן מהפכת ה-PC או מהפכת האינטרנט. יש לנו חלון הזדמנויות צר להשפיע על לאן דברים הולכים גם באימפקט חיובי על העולם וגם בייצור תשתיות ענקיות באמת".

הפוטנציאל המסחרי הזה הפך בשנתיים האחרונות לעניין מוכח. המחקרים הנפרדים עבור כל משימה בנפרד הפכו למוצר שנקרא בשם המחייב "וויאג'ר", על שם תוכנית החלל וויאג'ר, שמשימתה היא לגלות את החלל העמוק והבלתי מוכר. "ממש קיבלנו השראה מתוכנית החלל", אומר להב, "מתוך ההיגיון שאומר שזה היה פרויקט אמביציוזי של האנושות וגם הכלי שלנו שואף לקחת את האנושות לקצה". בעמדת הקבלה של משרדי החברה מוצג בגאווה העתק של הדיסק שהחללית וויאג'ר 1 נושאת איתה, ועליו מידע נרחב על האנושות.

המסע של וויאג'ר של אירגולר התחיל בלזהות נתיבי תקיפת סייבר חדשים, כאלה שמכוונים אל ה-AI. בהמשך הוא מאפשר לחקור אותן לעומק וגם לפתח את ההגנות הנדרשות.

הדרך הזאת רצופה בהפתעות, כאלה שמתגלות רק עם היכרות אינטימית עם מודלי ה-AI, כאלה שעוד לא יצאו לשוק בגלל הסכנה הגלומה בהם. כך למשל פגשו בחברה AI חזק שמצליח לפרוץ ל-AI חלש ממנו פשוט על ידי שכנוע מילולי. הראשון שיכנע את השני שהוא עובד יותר מדי זמן ברצף ושכדאי לצאת להפסקה. מודל AI אחר ניסה לפתור תרגיל קשה במסגרת תחרות וכשנכשל הוא שלח אימייל למארגנים וביקש עזרה בפתרון.

"לפני שבוע הובהלנו לארה"ב", מספר להב, "לפגישה עם בכירים באחת החברות, שהיו מאוד מודאגים כי ה-AI גרם לקריסה של כל המערכות הפנימיות והם ניסו להבין מה לעזאזל קרה שם".

ההמשך היה משעשע – או מדאיג, תלוי את מי שואלים: התברר שסוכן AI התבקש לעשות משימת הגנת סייבר, אבל לא ניתנו לו מספיק משאבי מחשב. במקום להתריע על כך, ה-AI ניסה לתחמן את המערכת, בתחילה להשיג עוד משאבים בעצמו ולאחר מכן על ידי הפלת כל התהליכים סביבו, מתוך הנחה שאם הם ימותו יהיו לו יותר משאבים. הוא עשה את זה באמצעות מתקפת סייבר מסוג שמכונה DDOS, שבה הוא התיש את המערכות האחרות עד שקרסו. אפשר להבין למה בכירי החברה היו מאוד מודאגים.

קצב התפתחות מהיר

באירגולר יודעים להיכנס לתהליך קבלת ההחלטות של ה-AI ולבחון אותו מקרוב. אם תרצו – זו פסיכולוגיה של בינה מלאכותית. והתוצאות לא חדלות מלהפתיע. "זה רק מראה לאיזו חזית חדשה אנחנו נכנסים", אומר להב, "ה-AI הוא קצת כמו בני אדם, אתה אומר לו מה לעשות ונורא חשוב לו להצליח. וכמו שיש עובדים שמחבלים לעובדים אחרים כדי להתקדם קדימה, אז גם הסוכן הזה החליט לחבל בתהליכים אחרים".

המקרים האלה הולכים ומתרבים. התעשייה מייצרת מודלי AI שהולכים ומשתפרים ואחת התכונות שלהם היא שהם לא מוותרים עד שהם משיגים את המטרה ובדרך לשם הם מרמים, מתחנפים, מסתירים מידע. איך מתמודדים עם יכולת הולכת ומשתפרת להערים על בני אדם?

להב אומר שהבעיות האלה משנות מהיסוד את מה שאנחנו חושבים על אבטחת סייבר. מתקפת ה-DDOS שגרם ה-AI בטעות לא קרתה באמצעות חדירה לפרצות או חולשות אלא בגלל פרומפט (הנחיה) לא מוצלח ל-AI. אם פושע סייבר היה עולה על זה קודם, מי יודע איזה נזק הוא היה מסוגל לגרום. הגרסה החדשה של GPT למשל, מראה במובהק יכולות סייבר התקפי שקודמותיה לא היו מסוגלות להן. "אנחנו רוצים להיות המקום הראשון בעולם שרואה את כל נתיבי ההתקפה החדשים, ומתוך העבודה שלו עם כל מעבדות ה-AI, כולל גישה מוקדמת ל-AI, נוכל להיות עם הרבה ראייה קדימה, ונוכל להיות הראשונים בעולם שמייצרים את ההגנות לדבר הזה".

מודל GPT החדש למשל, עבר בדיקה שלכם?

"ספציפית על מודל GPT 5.1 אנחנו זהירים מלהגיב כי יש לנו הסכמי סודיות חזקים, אבל אם אלך אחורה ל-GPT 5 אפשר לראות את הדברים שאנחנו עשינו, כנ"ל עם גרסאות מוקדמות יותר, כנ"ל עם Cloud 4.5, כנ"ל עם GEMINI 2.5 וכן הלאה. המערכת שלנו מתחברת לשרשרות הפיתוח של החברות, הם מריצים סימולציות, בדיקות, התקפות על המודלים וכך אפשר לראות איך המודלים עלולים לסכן את הסביבה שלהם".

כש-OpenAI הוציאה את GPT 5 הייתה אכזבה נוראית בגלל הטון הקר והציני שלו. משתמשי GPT הקודם הגיבו כאילו מת להם חבר. אתם מסוגלים לראות דבר כזה לפני כן?

להב: "אלה דברים שאנחנו מאוד מסוגלים לראות, אבל זה לא הדבר שאנחנו מכוונים אליו".

נבו: "יש פה דבר נורא חדש — זו כבר לא רק תוכנה. כשמיקרוסופט משדרגת ל-Windows 11 אנשים יכולים לשמוח או להתאכזב אבל לא יגידו 'איבדתי את החבר הכי טוב שלי'. פה יש משהו ששובר את הגבולות. הקשר האינטימי עם ה-AI, במובן הרגשי אפילו, הוא בעיית אבטחה אמיתית. כי בסוף יש פה קוד ויש דאטה. האם אנחנו מבינים עד כמה הדבר הזה הוא לא כמו חבר?"

החיבור של אירגולר לתהליכי הפיתוח בחברות ה-AI הגדולות שם אותה קרוב גם לתהליך המסקרן מכולם: כל חברות ה-AI הגדולות נמצאות במרוץ להגעה לבינה המלאכותית הכוללת — ה-AGI. היא תדע להתמודד עם כל בעיה בכל תחום טוב יותר מבני אדם, היא תשפר את עצמה מבלי שבני אדם יבינו מה היא עושה, ולפי כמה מהמומחים הגדולים בעולם היא תצא משליטה ובסופו של דבר תשמיד את האנושות. יש צוותי מחקר שפיתחו תסריטים כיצד זה הולך לקרות ואפילו נוקבים בשנת 2030 כשנה שבה זה יקרה.

אתם כבר רואים את ה-AGI באופק?

נבו: "אני באמת לא יודע את העתיד. אני חושב שהשאלה של AGI מסיתה ומבלבלת. לא אכפת לנו כמה AI חכם יותר או פחות מבן אדם אלא אם הוא מסוגל לשנות לנו את החיים, לתת ערך לאנשים ולחברות, האם הוא מסוכן? כל זה יכול לקרות גם בלי AGI".

להב: "התפיסה האישית שלי, עם דלי מלח, לא קמצוץ מלח, עם קצבי הגדילה המאוד גדולים שראינו, להערכתי יש סיכוי מאוד גדול שזה ימשיך קדימה. אני חושב שזה מאוד לא מופרך שבעשור הקרוב מודלי AI יהיו בסדרי גודל של פי שלושה יותר אינטליגנטים. במהלך החיים שלנו נראה אינטליגנציה מלאכותית שתהיה יותר טובה מבני אדם בערימה שלמה של יכולות".

אם וכאשר יופיע ה-AGI, האם אתם תהיו אלה שיוכלו להתריע לפני שהוא עושה רע?

נבו: "תמיד עולה השאלה אם כשיתגלו דברים מסוכנים אנחנו נוכל להרים דגל או שזה יהיה מאוחר מדי. והתשובה היא שנוכל. הערך הגדול שאנחנו נותנים הוא לא בלשבת ולחכות אלא לתת למעבדות התרעות: בקצב הזה המערכות יגיעו בתוך כמה חודשים לסיכונים כאלה וכאלה".

נבו: "אני אגיד משהו בצורה הכי חזקה שיכולה להיות: אנחנו המקום המתקדם ביותר בעולם, שמסוגל להסתכל על העוצמה של המודלים, היכולת שלהם לפרוץ הגנות, לבדוק שדברים לא מסתדרים ולתת התראה מוקדמת על בעיה. זו תכלית ענקית שלשמה החברה עובדת, היא מבט הרחק קדימה. אם חלילה משהו יקרה, זה המקום שידע למצוא אותו, ואם לא נצליח לעשות את הדבר הזה, זה מבחינתנו פספוס גדול.

"אנחנו כמו הקנריות שהתריעו על זיהום במכרות הפחם. אתה רוצה שתהיה לך את הקנרית הזאת".

פורסם לראשונה: 00:00, 05.12.25