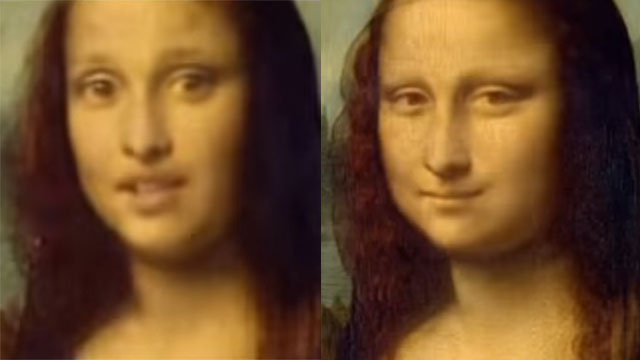

דה וינצ'י בהלם: מונה ליזה התעוררה לחיים

חוקרים מחברת סמסונג שיכללו את טכנולוגיית הזיוף העמוק (Deep Fake) והצליחו לייצר באמצעות תמונת סטילס אחת סרטונים של ידוענים שהלכו מזמן לעולמם - אלברט איינשטיין, מרילין מונרו ואחרים. באופן מדהים, זה עובד גם עם ציורים

החוקרים הרוסים שיכללו את הטכנולוגיה המכונה דיפ-פייק (deep fake) שמעוררת דאגה רבה בשנים האחרונות מכיוון שהיא מאפשרת ליצור סרטונים מזויפים. באחד הסרטונים הבולטים שנוצרו בטכנולוגיה הזאת נראה ברק אובמה מנבל פיו כלפי טראמפ, ובאחר "מופיעה" השחקנית סקרלט ג'והנסון בסצנת פורנו. סרטוני דיפ-פייק אחרים שימשו בין היתר להצגת דירות מוזנחות כארמונות פאר באתר AIRBNBD וגם לזיוף חתולים, שמעולם לא היו קיימים.

כדי לעשות דברים כאלה נדרשות אפליקציות פשוטות יחסית, שאוספות מידע ויזואלי מסרטון קיים או מאוסף גדול של תמונות של הדמות המושתלת. החידוש שמביאים חוקרי סמסונג לעולם הזיוף העמוק, הוא האפשרות להתבסס על תמונה בודדת של האדם כדי לייצר סרטון מלא שלו.

המחקר של אנשי מעבדת ה-AI של סמסונג במוסקבה, בשיתוף מכון סקולקובו למדע וטכנולוגיה, פורסם במאמר המפרט כיצד הצליחו לייצר דמויות נעות על בסיס תמונה בודדת שלהן. החוקרים הזינו למערכת ה-AI כ-7,000 סרטוני יוטיוב של ידוענים מדברים ואימנו אותה לזהות "נקודות ציון" על הפנים האנושיות. לאחר מכן השתמשו במערכת קיימת המכונה רשת הפקת עימותים (GAN), שבה משתמשים יצרני הזיוף העמוק: למערכת מוזנות גירסאות רבות של הזיוף המוצע, והיא פוסלת את כל המעוותים ומציפה את אלה שנתפסים אמינים. החוקרים מכנים את הטכניקה הזו "ראשים מדברים עצביים ריאליסטיים".

סימני שאלה מדאיגים

הידיעה על ההישג הטכנולוגי פשטה באתרי חדשות וטכנולוגיה בעולם, ועוררה סימני שאלה קשים. החשש העיקרי הוא שהטכנולוגיה מאפשרת עולם חדש ובלתי מוגבל של הונאות והטעיות. כך למשל אנחנו עלולים לחזות בסרטונים של פוליטיקאים שמצהירים הצהרות שמעולם לא אמרו ובכך ליצור מניפולציה של המערכת הפוליטית או הבינלאומית. סרטוני וידיאו נתפסים בדרך כלל כהוכחה ניצחת לאירועים שהם מתעדים. כעת מתאפשרים שני סוגים של הונאות: הצגת סרטונים מזויפים של אירועים שמעולם לא התרחשו, ומנגד פסילה של סרטונים אמיתיים המרשיעים עבריינים, בטענה שאין דרך להוכיח שאינם מזויפים. מנגד, אמר אחד המפתחים שעשויים להיות שימושים חיוביים לטכנולוגיה, למשל יצירת דמות חיה של קרוב משפחה שנפטר.

החוקרים הרוסים אינם הראשונים להציג יכולת בתחום זה. בשנת 2017 הציגו חוקרים מאוניברסיטת תל אביב טכנולוגיה דומה. פרופ' דניאל כהן-אור מבית-הספר למדעי המחשב והדוקטורנטית הדר אברבוך אלאור פיתחו מערכת להנפשת תמונות סטילס של אנשים בסיוע אנשי צוות צילום חישובי בחברת פייסבוק - ד"ר יוהאנס קופף וד"ר ומיכאל כהן. התוצאה היתה הנפשה קצרה של הדמות בצילום, כשהיא מחייכת, כועסת, משתאה - בהתאם לרגשונים המוכרים של פייסבוק. הטכנולוגיה החדשה משכללת את זו שפותחה בישראל, כשהיא מייצרת סרטון מלא שמדמה שיחה ריאליסטית לחלוטין.