צפייה בסרטוני ספורט, חדשות, פעלולים מסמרי שיער, "ממים" של חתולים ועוד מיליוני סרטונים ויראליים – כל אלו הפכו לחלק בלתי נפרד מחיינו. למעשה, וידאו מהווה יותר מ-80% מתעבורת האינטרנט, כאשר אנשים מעדיפים אותו על פני סוגים אחרים של תוכן.

צפו: דיפ פייק, כל אחד יכול

עם כניסת הבינה המלאכותית הגנרטיבית, הצפייה בסרטונים שנוצרו על ידי AI צפויה לעלות אף יותר. בשנת 2023, שוק הסרטונים שנוצרו על ידי בינה מלאכותית היה שווה כ-555 מיליון דולר והוא צפוי להכפיל את עצמו כמעט פי ארבעה ל-1.96 מיליארד דולר תוך חמש שנים, כך על פי נתוני חברת המחקר Grand View Research.

בעיית הדיפ פייק

הזינוק הנפיץ הזה חשף את הבעייתיות בסרטונים המשלבים בינה מלאכותית ויוצרים כותרות. ספציפית, סרטוני "דיפ פייק" הם בין האתגרים הבולטים ביותר הנובעים מהתפוצה הגדולה של טכנולוגיית בינה מלאכותית גנרטיבית כיום.

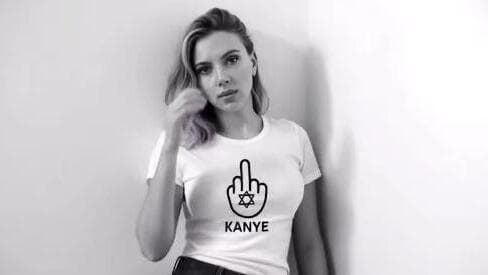

בעוד שבתחילת הדרך חלק מאותם סרטוני דיפ פייק היו לא יותר מפרודיות שלא באמת ניתן היה לקחת ברצינות, בהמשך נוצרו סרטונים הרבה יותר זדוניים מתמונות סטטיות וטקסט. המקרה האחרון הוא סרטון התגובה של שני היוצרים הישראלים לאמירות האנטישמיות של קניה ווסט (Ye), בו הופיעו דמויות שנוצרו על ידי AI של סלבריטאים יהודים מהוליווד. הסרטון אף גרר תגובה חריפה מהשחקנית סקרלט ג'והנסן שמופיעה בו.

אבל זו לא רק בעיה של סלבריטאים. הרשויות קבעו כי חלק מהסרטונים שנוצרים על ידי בינה מלאכותית פוגעים במגוון חוקי פרטיות, חוקי ניצול מיני, פוגעים בילדים ואפילו מפירים תקנות ביטחון לאומי הנוגעות לזיוף בחירות. נושא זה הפך כה חשוב, עד כי קליפורניה חוקקה לאחרונה את החקיקה הראשונה במדינה נגד דיפ פייק.

נראה כי הרגולציה לסגירת סרטונים שנוצרו על ידי בינה מלאכותית מעורפלת במקרה הטוב לעת עתה, ועלינו ללמוד מה לחפש בעצמנו כדי לזהות מה אמיתי ומה לא. במגזין "פורבס" פרסמו השבוע מדריך ובו חמש דרכים שיעזרו לכם לדעת אם קטע הווידאו הבא שתצפו בו נוצר על ידי בינה מלאכותית.

טיפים שיסייעו לכם לזהות סרטונים מזויפים

סנכרון פנים ושפתיים: בסרטונים שנוצרו על ידי בינה מלאכותית, במיוחד כשמדובר בדיפ פייק, אפשר פעמים רבות לזהות חוסר התאמה בין תנועות השפתיים למילים המדוברות. זה דומה לצפייה בסרטים זרים עם פסקול מדובב. חוסר התאמה יכול להיות אות לכך שמדובר בבינה מלאכותית.

בנוסף, לעתים קרובות אנשים לא ממצמצים באופן טבעי בסרטוני בינה מלאכותית גנרטיבית. כאשר בני אדם ממצמצים בעולם האמיתי, אנו עושים זאת במרווחים לא סדירים, הקשורים גם לרמזים מילוליים בשיחות. בנוסף, תנועות הפנים יכולות להיות חלקות מדי או מוגבלות – כל אחת מהן בולטת אם אתם מחפשים אותה. בינה מלאכותית עדיין לא שולטת בניואנסים האלה – גם אם בסופו של דבר היא תשלוט בהם, וזו הסיבה לכך שנחוצים גם כלי זיהוי וידאו של בינה מלאכותית.

כלי זיהוי של וידאו הנערך על ידי בינה מלאכותית: הכלי הראשון שיש לקחת בחשבון הוא Deepware - גלאי AI קל לשימוש המתמחה בסרטוני דיפ פייק על ידי ניתוח אי התאמות, פריים אחר פריים ואי סדר בהבעות פנים. גלאי שימושי נוסף מגיע מ-WeVerify, המציעה את תוסף הכרום שלה InVid Chrome, אותו ניתן להוסיף ישירות לדפדפן או לדפדפנים מבוססי כרומיום כגון אדג' של מיקרוסופט או Brave.

התוסף של WeVerify אף זכה במקום הראשון באתגר הטכנולוגיה האמריקאי פריז 2021 וזכה להמלצת מכון פוינטר ללא מטרות רווח לאתיקה עיתונאית. כך או כך, תמיד מומלץ להשתמש בכלי זיהוי מרובים, זאת כדי לאמת את תוצאות הכלי הראשון.

רעשי רקע ועיוותים: כפי שהם עושים עם תמונות שנוצרו על ידי בינה מלאכותית, לדור הנוכחי של פלטפורמות בינה מלאכותית גנרטיבית יש קושי מסוים לעבד במדויק פרטי רקע ועומק שדה בסרטונים.

לסרטוני בינה מלאכותית יש לעתים קרובות עיוותים קלים שיכולים להופיע כרעש, הבהוב או שינויים יוצאי דופן בתפאורה האחורית. עיוותים אלה נובעים בדרך כלל ממגבלות בתהליכי העיבוד של ה-AI. לצד זאת, צפו לכך שהם ישתפרו עם הזמן.

סרטון דיפ פייק של ראש ממשלת בריטניה לשעבר, בוריס ג'ונסון

חוסר התאמה רגשית: לבינה מלאכותית יש יכולת מוזרה להחדיר בעדינות דיאלוג מאולץ, הבעות מגושמות ומיקרו-מחוות לא טבעיות לסרטונים שלה. מעידות קטנות אלו יוצרות במצטבר חוסר התאמה בין הטון הרגשי של המילים המדוברות לתגובות המוצגות. שוב, הניתוק עדין, אך לעתים קרובות זה די והותר כדי ליידע אתכם שמשהו בסרטון לא ממש נכון ואולי לא אותנטי לחלוטין.

הווידאו חזק יותר מהעט: היכולת להפריד בין סרטונים אמיתיים למזויפים היא קריטית כאשר אתם שוקלים את כוחם של מסרי וידאו. המוח מעבד תמונות וידאו פי 60,000 מהר יותר מטקסט וכתוצאה מכך, 95% ממסר וידאו נוטה להישמר לעומת 10% בלבד מטקסט כתוב. לכן מומלץ מאוד לבדוק את המקורות של סרטונים שאתם רואים והאם התוכן שלהם מתאים למה שמוכר לכם ולהצליב את המסר עם מקורות נוספים.

מומלץ גם לשים לב להזיות, למשל אי דיוקים היסטוריים או מציאותיים. לא פעם היינו עדים לסרטונים שמציגים כביכול את ירושלים בתקופת הורדוס, כשברקע רואים היטב את מסגדי הר הבית או דמויות עם שש אצבעות שמתיימרות להציג נפגעים פלסטינים במלחמה בעזה. לכן מומלץ לשים לב לפרטים הקטנים האלה שיסייעו לכם לחשוד בסרטונים שכוללים לפעמים מסרים בעייתיים.