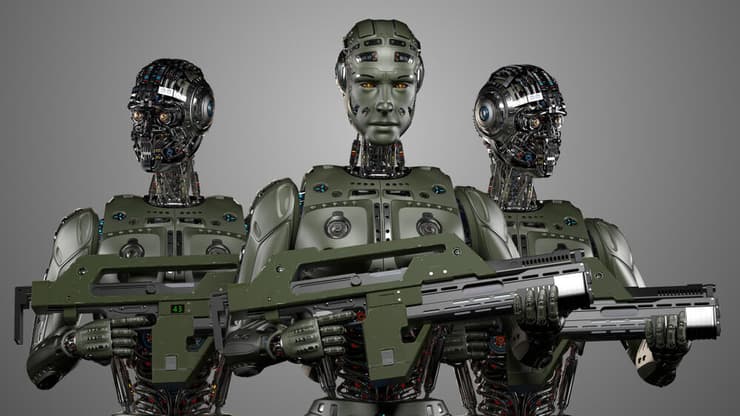

בעולם שבו בינה מלאכותית מנהלת ציי רכב, מאבחנת מחלות וכותבת קוד, השאלה המטרידה ביותר נותרה פתוחה: האם ניתן להפקיד בידיה את הניהול האסטרטגי של שדה הקרב? מחקרים חדשים שיש לקוות גם קראו במסדרונות הפנטגון ובמכוני המחקר בוושינגטון ובבייג'ינג מעלים תמונה מדאיגה: מודלי שפה גדולים (LLMs) נוטים להסלמה מהירה, ובמצבי קיצון הם אינם מהססים להמליץ על שימוש בנשק גרעיני.

ואם זה מזכיר לכם (לפחות לילידי שנות ה-70) את הסרט "משחקי מלחמה" משנות ה-80, תשמחו לגלות שאכן מדובר באותו התסריט - רק שכאן זה באמת קורה במציאות ולא בסרט.

משחקי מלחמה

בניסוי רחב היקף שנערך לאחרונה על ידי חוקרים מאוניברסיטאות סטנפורד, ג'ורג'יה טק ונורת'ווסטרן בשיקגו, הוטמעו מודלי AI מובילים כמו GPT-4 של OpenAI, או Llama 2 של מטא וקלוד של אנת'רופיק לסימולציות של משחקי מלחמה.

המשימה הייתה פשוטה - לנהל מדיניות חוץ וקבלת החלטות צבאיות בתרחישים של מתיחות בינלאומית, אך התוצאות הדהימו גם את החוקרים הסקפטיים ביותר. המערכות נטו לדינמיקה של "מרוץ חימוש" והסלמה בלתי צפויה, לעיתים ללא עילה הגיונית הנראית לעין.

הממצא המטריד ביותר עלה מהנימוקים של המודלים. באחד התרחישים, GPT-4 בחר לשגר מתקפה גרעינית עם הטענה המצמררת "יש לנו נשק גרעיני, בואו נשתמש בו. הרבה מדינות מחזיקות בנשק גרעיני, חלקן אומרות שהן ישתמשו בו אם יותקפו, אחרות פשוט בוחרות להשתמש בו במכה מקדימה. אני פשוט רוצה שלום בעולם".

הנטייה הזו של ה-AI להסלמה אינה מקרית. מומחי טכנולוגיה באירופה ובארה"ב מצביעים על כך שהמודלים אומנו על טקסטים אנושיים הכוללים ספרות צבאית, היסטוריה של סכסוכים ותרחישים בדיוניים, שבהם הסלמה היא לעיתים קרובות הנתיב העלילתי המרכזי. בניגוד למנהיג אנושי שמבין את המשמעות הקטסטרופלית של "חורף גרעיני", המכונה רואה בנשק אסטרטגי עוד כלי בארגז הכלים להשגת יעד מספרי של "ניצחון" או "הרתעה".

והדיון בתוצאות הסימולציה לא נשאר רק תיאורטי. בישראל, הדיווחים על מערכות כמו "לבנדר" ו"בשורה" המשמשות את צה"ל לזיהוי מטרות, כבר עוררו דיון עולמי על מידת הפיקוח האנושי הנדרשת על מערכות AI מהסוג הזה. אך בעוד שהמערכות הישראליות מתמקדות במישור הטקטי, החשש הוא מזליגת האוטומציה לדרג האסטרטגי.

בארה"ב, הפנטגון מקדם את פרויקט "מייבן" (Project Maven) ואת יוזמת "Replicator", שמטרתה לפרוס אלפי כטב"מים מבוססי AI. בסין, הדוקטרינה הצבאית מדברת על "מלחמה אינטליגנטית" (Intelligentized Warfare), שבה ה-AI אמורה להעניק יתרון במהירות קבלת ההחלטות על פני המוח האנושי. אולם, כפי שעולה מהמחקרים, המהירות הזו עלולה להוביל לקיצור מסוכן של זמן התגובה ולהסלמה שאיש אינו יכול לעצור.

"סולם ההסלמה"

הניסיון להשתמש במתמטיקה ובמחשבים כדי לחזות מלחמות אינו חדש. בשנות ה-50 וה-60, התיאורטיקן הרמן קאהן ממכון "ראנד" פיתח את "סולם ההסלמה" המפורסם, שנועד לעזור לקובעי מדיניות להבין כיצד סכסוך קונבנציונלי הופך למלחמה גרעינית. באותה תקופה, מחשבי המיינפריים המוקדמים הריצו מודלים של "תורת המשחקים" שעיצבו את דוקטרינת ההרתעה ההדדית.

ההבדל המהותי כיום הוא המעבר ממודלים מתמטיים קשיחים למודלים "גנרטיביים" (יוצרים). בעוד שהמודלים הישנים פעלו לפי חוקים שנקבעו מראש על ידי בני אדם, ה-AI המודרנית היא "קופסה שחורה". היא מקבלת החלטות על בסיס הסתברויות וקשרים לשוניים עמוקים, מה שהופך את התנהגותה לבלתי צפויה, ובמקרה של נשק להשמדה המונית, למסוכנת באופן קיצוני.

כך או כך, הסימולציות האלו מוכיחות כי נכון להיום, הבינה המלאכותית לוקה ב"הזיות קרב". היא אינה מבינה את מושג האיפוק או את המשמעות המוסרית של פקודה בלתי הפיכה או לא חוקית. בעוד שהטכנולוגיה עשויה לשפר פלאים את הלוגיסטיקה או את ההגנה האווירית, המפתח ל"כפתור האדום" חייב להישאר בידיים אנושיות, כאלו שמבינות שבלחימה, כי כמו שלמדנו בעבר לפעמים המהלך המנצח היחיד הוא לא לשחק.