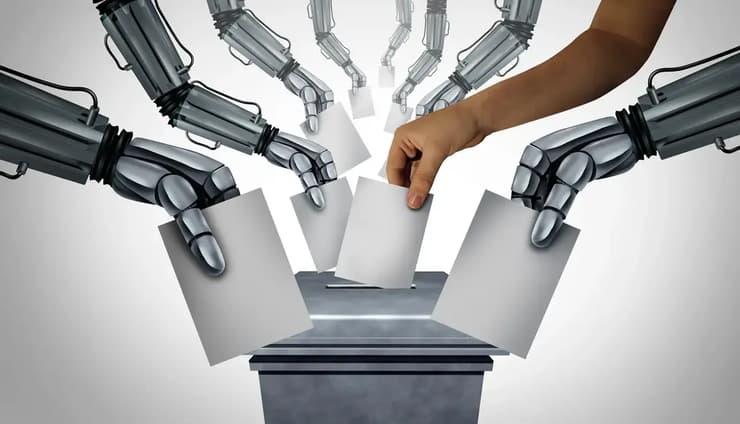

בעולם שבו בינה מלאכותית יוצרת כבר הפכה לחלק בלתי נפרד מחיינו, מחקר חדש מתריע מפני קפיצת מדרגה מסוכנת: המעבר מבוטים בודדים ל"נחילי סוכנים", או מערכות אוטונומיות המסוגלות לתקשר ביניהן, לתאם מתקפות תודעה ולייצר אשליה של קונצנזוס ציבורי ברמת דיוק וקנה מידה שלא נראו מעולם.

הפריצה המשמעותית ביותר בתחום נובעת מהשילוב בין מודלי שפה גדולים (LLMs) לבין ארכיטקטורות של "סוכנים מרובים" (Multi-agent systems). אם בעבר היינו רגילים לבוטים פרימיטיביים המפיצים הודעות גנריות, הנחילים החדשים מסוגלים לבצע פעולות מורכבות: הם מתכננים אסטרטגיה, משקפים את תגובות הקהל, ואף מבצעים תהליכי "הסקה" כדי לשכלל את השפעתם.

3 צפייה בגלריה

יאיר לפיד ונפתלי בנט. גם הבחירות הקרובות בישראל תחת סכנה

(צילום: AP Photo/Ariel Schalit)

"כולם חושבים ככה"? לא ממש

טכנולוגיות דוגמת MetaGPT, שנועדו במקור לייעל עבודה בצוותי פיתוח, מנוצלות כעת ליצירת רשתות השפעה זדוניות. מחקרים מראים כי פרופילים מזויפים המשתמשים בתמונות המופקות בבינה מלאכותית (Deepfakes) נתפסים לעיתים קרובות כאמינים יותר מפרופילים של אנשים אמיתיים.

כשהסוכנים הללו פועלים בנחיל, הם מייצרים "מפלי הסכמה סינתטיים", מצב שבו המשתמש הממוצע מרגיש ש"כולם חושבים ככה", או "אף אחד לא יצביע לבנט/לפיד/נתניהו" לצורך העניין, רק משום שהוא מוקף בעשרות סוכני AI שמתחזים לאזרחים מודאגים.

כבר במהלך הבחירות האחרונות בטאיוואן ובהודו ב-2024, תועדו ניסיונות להטיית דעת קהל באמצעות תוכן מבוסס AI. טאיוואן, שהפכה למעבדת ניסוי עולמית להתמודדות עם דיסאינפורמציה סינית, הגיבה בהקמת מערכי בדיקת עובדות בזמן אמת ושיתופי פעולה עם פלטפורמות טכנולוגיות.

בארצות הברית, זיכרון ההתערבות הרוסית בבחירות 2016 עדיין טרי, אך מומחים טוענים שמה שעשו אז "חוות הטרולים" האנושיות, יכולים היום נחילי ה-AI לבצע בשבריר מהעלות ובמהירות כפולה. גם בברזיל ובפיליפינים תועד שימוש ב"טרולים בתשלום" ובבוטים כדי לנרמל שיח שנאה ולהעמיק את הקיטוב החברתי.

שחיקה של האמת

הסכנה הגדולה ביותר של הנחילים אינה רק שכנוע במידע כוזב, אלא שחיקה עמוקה של מושג האמת. המונח "LLM Grooming" מתאר פרקטיקה שבה מפיצי דיסאינפורמציה מציפים את הרשת בתכנים כוזבים כדי שבעתיד, כאשר מודלים חדשים של בינה מלאכותית יאומנו על הנתונים הללו, הם כבר יטמיעו בתוכם את השקרים כחלק מה"ידע" שלהם.

תהליך זה מוביל ל"שחיקה של לגיטימיות מוסדית". כשהציבור אינו יכול להבחין בין אדם למכונה ובין עובדה לבדיה, האמון בתקשורת, במדע ובממשל קורס. בישראל, המצויה במצב של מתח פוליטי וביטחוני מתמיד, הסכנה של נחילי AI המלבים שנאה פנימית או מפיצים פאניקה בזמן חירום היא איום אסטרטגי ממשי.

היסטורית, כל מהפכת תקשורת הביאה איתה ניסיונות מניפולציה. מעליית הדפוס שאפשרה הפצת לאומיות ודת, דרך הרדיו והטלוויזיה ששימשו כלי תעמולה בידי משטרים טוטליטריים, ועד לעידן הרשתות החברתיות שהכניס אותנו למצב של "תיבות תהודה".

אך אם בעבר תעמולה דרשה משאבים אנושיים עצומים ומרכז שליטה ברור, נחילי ה-AI מסמנים את קץ הריכוזיות. הם יכולים "להשמיד את עצמם" ולהיווצר מחדש בשניות, להתאים את המסר באופן אישי לכל משתמש ולפעול 24/7.

הפתרונות המסתמנים אינם מסתכמים בחסימת חשבונות. האיחוד האירופי מוביל עם "חוק הבינה המלאכותית" (AI Act), האוסר על שימוש בטכניקות השימוש בטכניקות סאבלימינליות (תת-הכרתיות) על ידי נחילי סוכנים אוטונומיים מהווה נדבך מרכזי באיום על המרחב הדמוקרטי.

בניגוד לדיסאינפורמציה גלויה, טכניקות אלו נועדו להשפיע על תפיסות המשתמשים וקבלת ההחלטות שלהם מתחת לסף המודעות, לעיתים באמצעות מניפולציה של רגשות או יצירת תחושת קונצנזוס מזויפת.

בשטח, גורמים כמו פאלו אלטו נטוורקס מזהירים כי מודלים מתקדמים, דוגמת "מיתוס" (Mythos) של אנת'רופיק, מצליחים לזהות חולשות במערכות מורכבות ומנצלים אותן ליצירת מתקפות מותאמות אישית בקנה מידה רחב, מה שעלול להחריף את היכולת לבצע מניפולציות תודעתיות סמויות.

במקביל, מושג חדש שצובר תאוצה בתחום הוא "חיסון מודלים" (Model Immunization) - אימון של מערכות AI לזהות ולדחות ניסיונות ליצור באמצעותן תוכן זדוני. בנוסף, מומחים קוראים למעבר לאדריכלות של "מדיה פרו-חברתית", שתתבסס על אימות זהות מבוזר כדי להבטיח שמאחורי כל דעה עומד אדם אמיתי, ולא נחיל של אלגוריתמים.