הפלטפורמה של פייסבוק הפכה בחודשים האחרונים זירה לאחד המאבקים האלימים ביותר בעולם, שמתרחש עכשיו באתיופיה. באו"ם מזהירים שהמצב שם עלול להידרדר לרצח עם, ממש כמו שקרה במיאנמר לפני שנתיים, כשהרשת החברתית שימשה כלי להפצת שנאה כנגד שבט הרוהינגה, שהסתיימה ברצח עם המוני. באתיופיה מציפים עכשיו פרסומי שנאה את הרשת. מפרסמים אותם פעילים בכל הפלגים במדינה, כולל פרסומים ממשלתיים. הם כתובים בעשרות שפות שונות עם מסר אחד: שנאה ואלימות. בשנה שעברה נרצחו 80 בני אדם בגלל פוסט ויראלי, השנה נרצח זמר פופולרי אחרי הסתה אלימה כנגדו, שהופצה בפייסבוק.

נראה שלפייסבוק אין מושג מה לעשות. אחרי הטבח במיאנמר היא הודתה באופן פומבי: "לא עשינו מספיק כדי למנוע שימוש בפלטפורמה לעידוד אלימות". המנכ"ל מארק צוקרברג אמר שפייסבוק תשכור יותר דוברי בורמזית לסינון התכנים, והחברה הכריזה שהשקיעה בטכנולוגיה, בכוח אדם ובשותפויות כדי למנוע פרסומי שנאה. אז איך קורה ששנתיים לאחר מכן, עם כל הטכנולוגיה המתקדמת ועם מרכז סינון התכנים שפייסבוק הקימה גם באתיופיה, הפרסומים האלימים עם קריאות לשוד, ביזה ורצח, הופכים לוויראליים ברשת של פייסבוק, ומתממשים במעשי אלימות נוראיים בשטח?

זה לא שחסרים פרסומי שנאה בעולם המערבי. ההאשמות שפייסבוק נהנית כלכלית מפרסומי שנאה הפכו לקמפיין אפקטיבי של ארגונים חברתיים בארה"ב, תחת הדגל StopHateForProfit#. ביוני האחרון שורה של חברות מסחריות נמנעו באופן מוצהר מפרסום בפייסבוק, בהן קוקה קולה, North Face, אדידס, בסט ביי, פורד, הונדה, יוניליבר ועוד רבות. פייסבוק הגיבה לקמפיין וטענה שהיא פועלת נמרצות, ואפילו מינתה סגן נשיא שאחראי להתמודדות עם השנאה. איכשהו זה לא שכנע את ארגוני הפעילים, שטוענים שפייסבוק ממשיכה לעשות הון עתק מפרסומי השנאה.

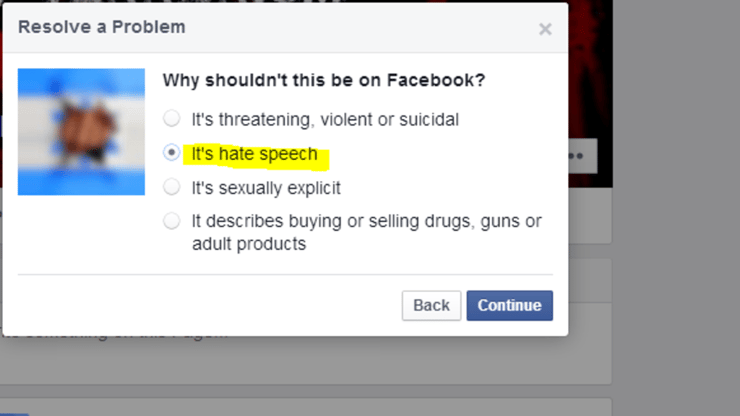

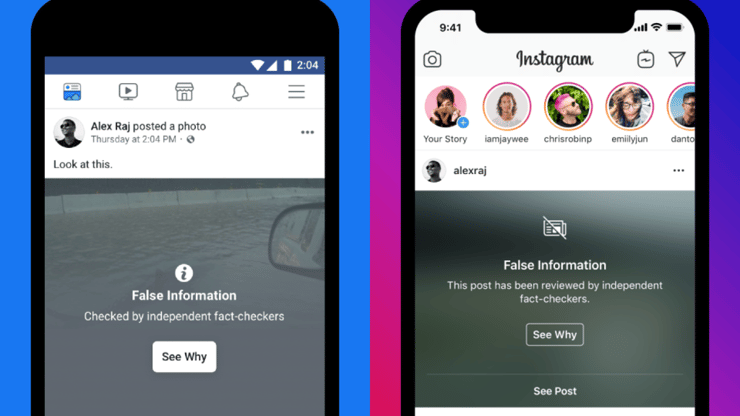

גם אם מניחים שפייסבוק כנה בכוונותיה לעצור פרסומי שנאה, ברור שהכלים שהיא משתמשת בהם לא אפקטיביים מספיק. החברה מפעילה מערכת בינה מלאכותית לזיהוי אוטומטי של פוסטים אסורים ומרכזי סינון תכנים אנושיים, שעוברים על הפוסטים לאחר מכן ומחפשים דברים שהבינה המלאכותית לא זיהתה. לאחרונה פייסבוק הכריזה על החמרה במדיניות מול מנהלי קבוצות שמאפשרים פרסומי שנאה, עד כדי מחיקת קבוצות. בשנה האחרונה היא מחקה יותר ממיליון קבוצות, כ-1.5 מיליון תוכני שנאה מאורגנת (organized hate) וכ-12 מיליון תוכני דיבור שנאה (hate speech), רובם לדבריה עוד לפני שקיבלה תלונות לגביהם. ובכל זאת, פרסומי השנאה וההסתה ממשיכים להציף את הרשת.

בינה מלאכותית כותבת ביטויי שנאה

בפייסבוק כנראה מודאגים מאוד. בניסיון חדש להתמודד עם הבעיה החברה השקיעה סכומי כסף גדולים בגיוס המוחות האקדמיים למציאת פתרונות. בפברואר היא פרסמה קול קורא להצעות, והבטיחה מענק מחקר של 100 אלף דולר למחקרים שייבחרו. במאי היא פרסמה את התוצאות: 184 הצעות הוגשו, התוצאה היא 19 כיוונים חדשים, חלקם מחקרים לאיסוף מידע וחלקם מחקרים לפיתוח כלים חדשים להתמודדות עם אלימות ברשת.

שתיים מההצעות הזוכות הגיעו מחוקרים ישראלים: הצעה לניתוח התבטאויות ארגוני טרור בינלאומיים, שהגישה קבוצת חוקרים במכון למדיניות נגד טרור (ICT) במרכז הבינתחומי בהרצליה, והצעה לפיתוח שיטה חדשה של ד"ר אמיר אדלר לאיתור משפטי שנאה, גם אם השנאה בהם מרומזת או מוסווה. מדובר במחקר שכיום מבוצע ע"י תומר וולך, סטודנט לתואר שני בחוג למערכות מידע באוניברסיטת חיפה, עם המנחים ד"ר אדלר ממכללת בראודה (ועמית מחקר ב-MIT) וד"ר עינת מינקוב מהחוג למערכות מידע באוניברסיטת חיפה. הכלי שפותח במסגרת המחקר מציג פתרון לאחת הבעיות המרכזיות של פייסבוק: הקלות הרבה בה ניתן לשטות באלגוריתם הסינון של פייסבוק.

וולך מציג דוגמאות למשפטים שלא סוננו. למשל "קופים אפריקאיים עם נשים לבנות אטרקטיביות" או "למה לתת לשחורים לחיות?". כותבי הפוסטים לומדים במהירות איך לנסח את דברי הרעל שלהם בלי להפר את "כללי הקהילה" של פייסבוק. בקרב המוחות שמתחולל בפלטפורמה, משתמשים שרוצים להפיץ רוע ישנו את הניסוח שוב ושוב, עד שהאלגוריתם יובס.

לדברי וולך, הבעיה היא שמערכות הסינון אומנו על כמות מצומצמת של נתונים, והן מוגבלות בזיהוי הביטויים והסגנון. "זה צוואר הבקבוק העיקרי, כפי שאנחנו מבינים מפייסבוק. המודלים של ה-AI אומנו על מאגר מידע קטן. אז יכול להיות שהם הגיעו לתוצאות מדהימות של 90 אחוזי זיהוי ויותר עם אותו מידע, אבל הם מתרסקים כשמשנים את הנתונים למשל לציר זמן אחר. הם מגיעים ל-40 אחוזי זיהוי, פחות מהטלת מטבע", הוא אומר.

הפתרון של וולך, אדלר ומינקוב הוא לייצר באמצעות AI מאגר מידע ענק, מיליוני משפטים שמיוצרים באופן אוטומטי, חלקם חיוביים, חלקם מכילים ביטויי שנאה מובהקים וחלקם נרמזים. "המשפטים שלנו כוללים אפילו האשטגים. איש לא יכול לדעת שאלגוריתם ייצר אותם. הם נראים יותר אותנטיים מכמה משפטים אמיתיים שראינו, כאלה שנראים כמו ג'יבריש מוחלט למרות שאדם כתב אותם", אומר וולך.

ההחלטה של פייסבוק לבחור בהצעה שלהם כאחת הזוכות מעודדת את וולך להאמין שפייסבוק עשויה להטמיע את השיטה החדשה במערכות שלה, וכך לשפר מאוד את היכולת של ה-AI שלה לסנן תכני שנאה. האם זה מה שיפתור את כל הבעיות של פייסבוק בהרגעת השיח ברשת? ספק גדול.

הבעיה המהותית טמונה במוטיביציה לכל מה שפייסבוק עושה, כפי שאפשר לראות גם בסרטו החדש של ג'ף אורלובסקי "מסכי עשן: המלכודת הדיגיטלית" שעלה בימים אלה בנטפליקס: האלגוריתם של פייסבוק מקדם פוסטים משיקול אחד בלבד: ההכנסות הצפויות מהם. ביטויי שנאה הם מקדמי מכירות מצוינים. הריח אולי מצחין אבל לכסף אין ריח.

מחקר של פרופ' יפעת מעוז וטל אוריאן-הראל מהאוניברסיטה העברית וד"ר ג'סיקה כץ-ג'יימסון מאוניברסיטת צפון קרוליינה מצביע על פגמים בהתנהלות הקבוצות בפייסבוק, שגורמים להתגבשות הקצנה וביטויי שנאה כלפי מי שנתפסים כלא שייכים לקבוצה. החוקרות ממליצות על שינוי האלגוריתם של פייסבוק, כך שיעודד הצגת דעות מגוונות בפני המשתתפים ויפחית את הקיטוב.

למעשה מדובר בדבר ובהיפוכו: מצד אחד פייסבוק עושה מאמצים כבירים להתמודד עם פרסומי השנאה באמצעות אלגוריתם סינון ומהצד האחר אלגוריתם קידום התכנים וההכנסות שלה מעודד אותם בהתלהבות. כל עוד המודל הכלכלי של פייסבוק לא ישתנה, אנחנו נדונים להמשיך ולחזות בפרסומי שנאה ולפרקים גם הסתות לרצח.

בינה מלאכותית וחוכמת ההמונים

יכול להיות שסינון תכנים באמצעות טכנולוגיה אינו הפתרון האפשרי היחיד. גישה אחרת לחלוטין מציגה חברת אופן ווב (Open Web) הישראלית (לשעבר Spot.im): החברה פיתחה טכנולוגיה מבוססת בינה מלאכותית וחוכמת המונים, שנותנת עדיפות לתוכן איכותי של פוסט ולא להכנסות ממנו וכך מתמרצת את המשתתפים בשיח לכתוב תגובות ענייניות ומעניינות ולהימנע מכתיבת השמצות וביטויי שנאה.

רועי גולדברג, מייסד שותף וסמנכ"ל תפעול (COO) באופן ווב, אומר שהאסטרטגיה של פייסבוק, שמבוססת על העסקת עשרות אלפי מסנני תוכן לא מצליחה להתמודד עם הכמות הגדלה ללא הרף של פרסומים בעייתיים, וגם לא להבין את ההקשרים הייחודיים לכל קהילה. "אני חושב שבפייסבוק זה לא רק עניין של אלגוריתמים, אלא הרבה יותר עמוק, ב-DNA של חברה", הוא אומר, "המודל העסקי שלהם, שמתמרץ את המשתמשים, הוא להעלות למעלה את הפוסטים שמקבלים יותר תגובות, ואלה הרבה פעמים מכילים ביטויים סופר אלימים. קשה לצאת מהמודל העסקי הזה גם אם הם ישקיעו עוד ועוד באלגוריתמים".

אופן ווב מתמקדת היום בשיפור השיח בטוקבקים, התגובות לכתבות באתרי מדיה, ממש כמו כאן בתחתית כתבה זו. יש לחברה כמה רעיונות רעננים שנועדו לגרום לטוקבקיסטים לשנות את דרכיהם. "אנחנו מאמינים שכל אחד יכול להיות איש שיחה טוב", אומר גולדברג. לדבריו הכל תלוי בסביבה שמוצגת בפני המשתמש ובתמריץ שנותנים לו.

הסביבה, פירושה צמרת רשימת הטוקבקים, שרק היא מוצגת אוטומטית לקוראי הכתבה. בניגוד לפייסבוק, ברשימה של אופן ווב יופיעו רק הפוסטים האיכותיים ביותר, שתורמים לשיח. פוסטים אחרים יידחקו למטה, ואם הם מכילים ביטויי שנאה או אלימות, הם יימחקו כליל. המחקרים של אופן ווב מצאו שבסביבה כזו, הנטייה של טוקבקיסט, אפילו עצבני, לכתוב בצורה מתונה ומנומקת עולה בעשרות אחוזים.

מאחורי הקלעים של אופן ווב פועל אלגוריתם ניתוח תוכן, מערכת לימוד מכונה משוכללת, שמאומנת ללא הרף על בסיס תגובות של מנהלי שיח אנושיים. האלגוריתם מדרג את ההתבטאויות לפי התוכן שלהן ולפי ההיסטוריה של הכותב ואילו תגובות קיבל בעבר. כל מה שמתברר כשנאה, טרולינג, ספמינג, בולינג, נמחק. כל השאר מדורג לפי איכות התרומה לשיח והטובים יותר מקודמים לצמרת הטוקבק.

עכשיו נכנסה תכונה חדשה ומעניינת: רגע לפני המחיקה של פוסט בלתי ראוי, מנוע ה-AI נותן משוב למשתמש: "הבחנו שהתגובה שלך מפרה את כללי הקהילה, האם אתה בטוח שאתה רוצה לפרסם אותה?" לדברי גולדברג, 30 אחוזים מהמשתמשים משנים את התגובה כתוצאה מהמשוב.

יכול להיות שיש בעיה בהחלטה לתת לבינה מלאכותית לקבוע מהו תוכן איכותי ומה הוא זבל. גולדברג אומר שהטכנולוגיה שפיתחו מבוססת על לימוד הדרך בה בני אדם קוראים את הטקסטים: "אנחנו משתמשים באלגוריתם רחב של למידת מכונה, שמזהה את הטקסט ואת הסנטימנט ואז משווה את זה למיליוני החלטות אנושיות בעבר. זו מערכת לומדת אמיתית".

אבל הוא מודה שבינה מלאכותית לבדה לא מספיקה. זו הסיבה שהחברה מנהלת ברציפות סקר בקרב המשתמשים, ושואלת את דעתם על איכות השיחה והתכנים הבעייתיים בה. "אם שיחה מגיעה לאסקלציה לא טובה, אם עולה נושא רגיש, אנחנו יכולים לשנות לפי התשובות לסקר את המנגנון שלנו מאחור. כך אנחנו יכולים לבדוק את עצמנו ולא להתבשם מאיך שאנחנו מנהלים את הדיונים".

שילוב הקהילה בניהול הדיונים הוא אולי היוזמה המעניינת והמאתגרת ביותר של אופן ווב, באמצעות פיתוח מערכת לניהול דיונים קהילתי (community moderation). מסביר גולדברג: "אנחנו יודעים להבין היום כמה כל משתמש תרם בהחלטות טובות לקהילה, וכך למנות משתמשים מסוימים להיות מנהלי הדיון, שיכולים להוריד תגובות פוגעניות, להעלות למעלה דברים רלוונטיים וגם להשיב למשתמשים ששואלים למה חסמו הודעה שלהם. עצם ההתערבות בשיח מעלה משמעותית את האיכות. יש לנו שאיפות מאוד גבוהות עבור המערכת הזאת".

המערכת של אופן ווב פותחה בישראל ועובדת בעברית כמו גם באנגלית, תכונה יוצאת דופן בעולם זיהוי התוכן (NLP) שרובו קיים רק באנגלית. בתקופה הקרובה ניתן יהיה להתרשם מיכולותיה, שכן היא תופעל במערך הטוקבקים של אתר ynet.