מודלי השפה הגדולים (LLMs) שפרצו לחיינו בשנים האחרונות מעוררים התרגשות רבה, אבל בשיח הציבורי חסר הסבר על מנגנון פעולתם ויש לכך השלכות שליליות רבות. ללא הבנה של מנגנון הפעולה הבסיסי אי אפשר להבין היכן כלים כאלה יכולים להועיל, והיכן הם מזיקים. במאמר זה אסביר את עיקרון הפעולה של מודלי שפה גדולים בשפה פשוטה, כך שגם מי שאינו בקיא במדעי המחשב יבין כיצד הם עובדים וכיצד יש להשתמש בהם מבלי להינזק.

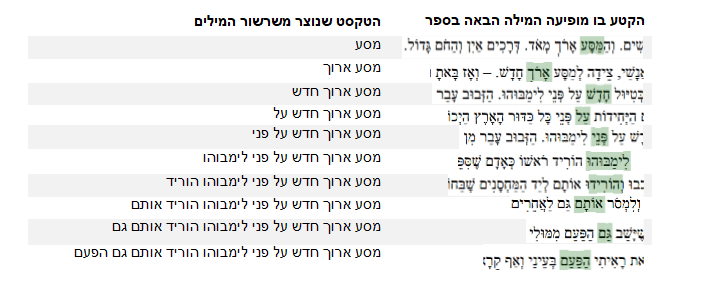

עיקרון הפעולה של מודלי שפה תואר בשנת 1948 על ידי המהנדס קלוד שאנון במאמרו פורץ הדרך "על תיאוריה של תקשורת". במאמר, מראה שאנון שלטקסטים בשפה טבעית (אנגלית או עברית למשל) יש מבנה סטטיסטי, כלומר מילים לא מופיעות בזו אחר זו באקראי. למשל אחרי "בוקר" יש סיכוי גבוה שתופיע המילה "טוב", הרבה יותר מ"קלמנטינה". אדגים זאת כפי ששאנון תיאר במאמרו: נבחר ספר, נבחר באקראי מילה, נרשום אותה, נחפש את המופע הבא שלה בספר, נבחר את המילה שבאה אחריה, נרשום אותה - וחוזר חלילה. הנה דוגמה שיצרתי מהספר "לובנגולו מלך זולו" של נחום גוטמן:

נשים לב לשלושה דברים: ראשית, המשפט נשמע הגיוני. שנית, הוא מתייחס לנושא הספר (שמתאר מסע לאפריקה), לבסוף, זהו משפט חדש שלא מופיע בשום מקום בספרו של גוטמן.

מה קורה כאן? הבחירה של המילה הבאה במשחק היא אומנם אקראית, אבל היא מבוססת על צירופי מילים שיש להם סיכוי גבוה יותר להופיע בטקסט מאשר בחירה אקראית לחלוטין. עכשיו דמיינו שאנחנו מחשבים בטבלה, לכל מילה, את הסיכוי שהיא תופיע בהינתן סדרת מילים שהופיעו לפניה. אם נבנה את הטבלה כך שנתחשב בשלוש מילים אחורה, נוכל לקבל משפטים שנשמעים הגיוניים באורך של עד כשש מילים. אם נבנה את הטבלה כך שנתחשב ב-30 מילים אחורה, נוכל לייצר קטעי טקסט הגיוניים ובעלי משמעות באורך של כ-60 מילים.

ד"ר דוד פייטלסוןצילום: גבי מימון

ד"ר דוד פייטלסוןצילום: גבי מימוןאלא שיש כאן שתי בעיות. אחת, ככל שנסתכל אחורה על יותר מילים, הטבלה שלנו תגדל בקצב עצום. שתיים, כדי לקבל קירוב טוב נזדקק לכמויות עצומות של טקסט. היכולת של מודלי שפה גדולים לעשות זאת היא תוצאה של תהליכים מדעיים, חברתיים וטכנולוגיים שהתגברו על שתי הבעיות שתיארתי: ראשית, מהפכת האינטרנט יצרה מאגר עצום של טקסטים שניתן לנתח בעזרת מחשב. שנית, השיפור העצום בכוח החישוב ופיתוח אלגוריתמים חכמים אִפשרו להימנע מבניית טבלת הסיכויים במלואה, ולבצע את החישוב הזה באופן מעשי.

ריפרש

החברה הישראלית שהמציאה מחשב עם משקפיים במקום מסך / עם טמיר ברלינר

42:48

לסיכום, מודל שפה גדול הוא מערכת ליצירת טקסט, שעיקרון הפעולה שלה נשען על חישוב טבלת סיכויים גדולה בעזרת ניתוח כמות אדירה של טקסטים, ועל יצירת טקסטים חדשים בעזרת תהליך אקראי שבחירת המילים שלו מבוססת על טבלת הסיכויים. השלב הראשון דורש משאבים עצומים וזמן רב. הפקת הטקסט אחרי שהטבלה כבר מוכנה, פשוטה וזולה הרבה יותר מבחינה חישובית.

כמובן שנדרשים פיתוחים מדעיים וטכנולוגיים רבים כדי להפוך את העיקרון הזה למוצר שימושי. מטרת התיאור הנ"ל היא לא להמעיט בהישגים המרשימים האלה, אלא לשמש ככלי להבנת ההשלכות של תסריטי שימוש שונים במודלי שפה גדולים.

השלכות על נכונות

אחת התופעות המדוברות ביותר בכל הנוגע לבינה מלאכותית יוצרת (GenAI) היא "הזיות" - הנטייה של מודלי שפה להמציא מידע ללא ביסוס עובדתי. אבל אסור לטעות ולחשוב ש"הזיה" היא תקלה. המילה "הזיה" מעודדת אותנו לחשוב שיש כאן תבונה שלעיתים משתבשת. אבל למעשה, המערכת הזו תמיד "הוזה", כלומר המערכת תמיד עובדת באותו האופן וה"הזיה" היא תוצאה טבעית של פעולתה. למעשה, מודל שפה טבעית תמיד ממציא את הטקסט, לכן הדבר היחיד שהמערכת הזו יכולה להבטיח הוא שהטקסט שהיא מייצרת ישמע "הגיוני", אבל אין לה שום דרך לוודא שהוא נכון. במקרה שאנחנו משתמשים בו כדי לאחזר מידע, מוטלת עלינו החובה לבדוק (למשל בעזרת מנועי חיפוש) שהטקסט שהמערכת יצרה מתאר מידע נכון.

השלכות על מקוריות

בגלל האופי האקראי של התהליך, הטקסטים שמערכת כזו מפיקה הם לרוב חדשים. לכן, אם נפנה שוב ושוב עם אותה שאילתה למודל, נקבל בכל פעם תשובה אחרת. אבל המערכת, מעצם עיקרון פעולתה, לא יכולה לייצר יצירה שהסטטיסטיקה שלה שונה ממה שנוצר עד עכשיו. זה כמו ההבדל בין מוזיקאי שמעבד יצירה בסגנון מוצארט, למשל, לעומת מוצארט עצמו, שהמציא שפה מוזיקלית חדשה (שיש לה סטטיסטיקה אחרת) שלא הייתה קיימת עד אז.

השלכות על חישובים והסקת מסקנות

יש להיזהר מאוד משימוש בטקסטים שמכילים חישובים או ניתוחים לוגיים, מכיוון שהתוצאות תמיד נשמעות סבירות, אבל אין שום ביטחון שהחישובים ותהליכי הסקת המסקנות בהם נכונים.

השלכות על קבלת החלטות בתנאי אי-ודאות

כשמציגים בפני מודלי שפה בעיות חדשות, אי אפשר לצפות עד כמה תהיה רחוקה התגובה ממשהו סביר. למשל, רכב אוטונומי (ה-AI שלהם מבוסס על עקרונות דומים למודלי שפה) גרם לתאונת דרכים כשעצר באמצע פנייה בצומת סואן, מכיוון שהחליט שהרכב שבא מולו מתכוון לפנות ימינה.

השלכות על דיסאינפורמציה

קשה מאוד להילחם בדיסאינפורמציה, בטח כשהיא נשמעת מאוד אמינה והגיונית, וזה, כפי שכבר ראינו, הוא בבסיס עיקרון העבודה של מודלי שפה. בנוסף, תהליך יצירת הטקסט הוא זול ומהיר. כלומר מודלי שפה מסוגלים לייצר במהירות כמויות גדולות של טקסט שנשמע כאילו הוא נכון. ללא פיקוח מתאים יהיה קל מאוד להשתמש בהם כדי להציף את הרשת בדיסאינפורמציה.

הערה על טענת ה"טכנולוגיה בחיתוליה"

תגובה נפוצה לרבות מהמגבלות שתיארתי היא שהטכנולוגיה נמצאת בחיתוליה, ושהמגבלות יוסרו בגרסאות הבאות. יש שתי בעיות בטענה זו. ראשית, הטכנולוגיה אינה חדשה כל כך, היא נמצאת בפיתוח כבר כשני עשורים. כדאי לקרוא את ההיסטוריה של מערכת ווטסון שפיתחה IBM לפני כעשור. המערכת הזו ניצחה בשנת 2011 בתחרות Jeopardy את שני אלופי העולם האנושיים, ו-IBM חשבה שווטסון תוכל להחליף רופאים בביצוע דיאגנוזות רפואיות.

בפועל, המערכת סבלה מאותן מגבלות שתיארנו כאן, והתוכניות האלה נגנזו. שנית, הבסיס המדעי שעליו נשענת הטכנולוגיה הונח לפני כ-80 שנים. כדי שהמערכת תוכל להתגבר על המגבלות היסודיות שלה יש צורך בבסיס מדעי אחר, אך בסיס כזה לוקח שנים רבות לפתח.

ד"ר דוד פייטלסון הוא ראש בית הספר להנדסת תוכנה באפקה, המכללה האקדמית להנדסה בתל אביב